Bondade do ajuste, an alise de res duos bayesiana em ... · Lobo, Viviana Bondade do ajuste, an...

Transcript of Bondade do ajuste, an alise de res duos bayesiana em ... · Lobo, Viviana Bondade do ajuste, an...

Universidade Federal do Rio de Janeiro

Departamento de Metodos Estatısticos

Curso de Pos-graduacao em Estatıstica

Viviana das Gracas Ribeiro Lobo

Bondade do ajuste, analise de resıduos bayesiana em modelos espaciais

Rio de Janeiro

2014

Viviana das Gracas Ribeiro Lobo

Bondade do ajuste, analise de resıduos bayesiana em modelos espaciais

Dissertacao apresentada ao Curso de Estatıstica da UFRJ,

como requisito para a obtencao do grau de MESTRE em

Estatıstica.

Orientadora: Thaıs Cristina Oliveira da Fonseca

PhD em Estatıstica

Rio de Janeiro

2014

Lobo, Viviana

Bondade do ajuste, analise de resıduos bayesiana em modelos espaciais / Vivi-

ana Lobo - 2014

xx.p

. I.Tıtulo.

CDU xxxx

Viviana das Gracas Ribeiro Lobo

Bondade do ajuste, analise de resıduos bayesiana em modelos espaciais

Dissertacao apresentada ao Curso de Estatıstica da UFRJ,

como requisito para a obtencao do grau de MESTRE em

Estatıstica.

Aprovado em, 8 de Maio de 2014

BANCA EXAMINADORA

Thaıs Cristina Oliveira da Fonseca

PhD em Estatıstica

Fernando Antonio da Silva Moura

PhD em Estatıstica

Marcia D’Elia Branco

DSc em Estatıstica

Resumo

Dados georeferenciados frequentemente apresentam observacoes atıpicas ou regioes com heterocedastici-

dade espacial. Modelos baseados na suposicao de gaussianidade nao sao os mais adequados para este

problema. Uma alternativa e a utilizacao de modelos com caudas mais pesadas, permitindo uma maior

flexibilidade no tratamento dessas observacoes. Neste trabalho, sao propostos metodos de diagnostico

para analise e deteccao de outliers, atraves de funcoes de influencia espacial, analise de resıduos baye-

sianos e p-valores bayesianos num contexto espacial. Outras ferramentas de diagnostico sao abordadas

para deteccao de outliers baseados na distribuicao preditiva, como a concordancia preditiva (PC) e a or-

denada preditiva condicional (CPO) e teste de Savage-Dickey. Alem desses, sao propostos neste trabalho

a probabilidade mais conservadora (McP) e o p-valor do CPO (CPOp). Num contexto de comparacao

de modelos, utilizou-se o fator de Bayes usual e fracionario, mostrando vantagens e desvantagens em sua

aplicabilidade quando ha presenca de outliers. Foram utilizados dados simulados segundo varios cenarios

de contaminacao por valores atıpicos. Tres modelos espaciais propostos na literatura sao ajustados e

comparados para os cenarios e metodos propostos.

Palavras-chaves: deteccao de outliers, analise de resıduos, p-valores bayesianos, estatıstica espacial

Abstract

Georeferenced data often present atypical observations or regions with spatial heterocedasticity. Models

based on the assumption of gaussianity are not optimal for this problem. An alternative is to use

models with heavier tails, allowing flexibility in the treatment of these observations. In this dissertation

we propose methods for detection and analyze of outliers, through spatial influence functions, bayesian

residual analysis and bayesian p-values in a spatial context. Other diagnostic tools are discuessed for

outlier detection based on the predictive distribution, as predictive concordance (PC) and the conditional

predictive ordinate (CPO) and Savage-Dickey test. In addition to these, are proposed in this work the

most conservative p-value (McP) and p-value of CPO (CPOp). In the context of model comparison, are

used the usual and fractional Bayes factor, showing advantages and disadvantages in its application when

there are presence of outliers. Three spatial models proposed in the literature are adjusted and compared

to the scenarios and proposed methods.

Keywords: outlier detection, bayesian residual analysis, bayesian pvalue, spatial statistics.

Agradecimentos

Agradeco a minha famılia, pelo apoio incondicional.

Aos meus amigos, em especial a Natalia S. Paiva companheira de guerra desde os tempos

de graduacao, Aniel Ojeda pela grande ajuda e contribuicao matematica ao longo do curso, Eduardo F.

Gomes pelas discussoes sobre a definicao da probabilidade mais conservadora e aos rapazes, Fernando G.

Aragao, Rafael Jorge Pereira e Rafael Barcellos.

Aos meus orientadores: de graduacao Dirley M. dos Santos, pelo incentivo, de mestrado

Thais C. O. Fonseca, pela colaboracao e conhecimentos repassados a mim, me dando a oportunidade de

aprender novos conceitos e metodos ao longo do trabalho.

Aos membros da banca, por terem disponibilizado seu tempo para contribuicao deste tra-

balho, Fernando A. S. Moura e Marcia D’Elia Branco.

Universidade Federal do Rio de Janeiro e a CAPES pelo apoio financeiro, do qual possibili-

taram a oportunidade de dar continuidade aos meus estudos.

Sumario

Lista de Tabelas 9

Lista de Figuras 11

1 Introducao 13

1.1 Estrutura e classificacao dos outliers . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 14

1.2 Exemplo de motivacao . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 15

1.3 Delineamento da dissertacao . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 17

2 Estatıstica espacial 18

2.1 Modelo Gaussiano . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 18

2.2 Modelo de Mistura Espacial . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 18

2.3 Classes de Covariancias . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 20

2.3.1 Classe Matern . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 20

2.3.2 Classe Cauchy Generalizada . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 22

2.4 Inferencia bayesiana . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 23

2.4.1 Distribuicao a Priori . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 23

2.4.2 Distribuicao a posteriori e distribuicao preditiva . . . . . . . . . . . . . . . . . . . 25

3 Exemplo simulado e contaminacao de dados 26

3.1 Estimacao dos parametros . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 27

3.1.1 Modelo Gaussiano - Classe Matern . . . . . . . . . . . . . . . . . . . . . . . . . . . 28

3.1.2 Modelo T-Student multivariado . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 30

3.1.3 Modelo GLG - Classe Matern . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 32

3.2 Comportamento dos λ’s no modelo GLG . . . . . . . . . . . . . . . . . . . . . . . . . . . . 35

4 Funcoes de influencia espaciais 37

4.1 Funcao de influencia . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 37

4.2 Caso Espacial . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 39

4.2.1 Caso Gaussiano . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 39

4.2.2 Caso T-Student Multivariado . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 40

4.2.3 Caso GLG . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 41

4.3 Exemplo Simulado I . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 44

4.3.1 Caso Gaussiano . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 44

4.4 Exemplo Simulado II . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 47

5 Analise de resıduos e deteccao de outliers em modelos espaciais 52

5.1 Analise bayesiana de resıduos para deteccao de outliers . . . . . . . . . . . . . . . . . . . 53

5.1.1 Escolha do limiar t . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 54

5.2 Deteccao de outliers baseados na preditiva . . . . . . . . . . . . . . . . . . . . . . . . . . . 55

5.2.1 Concordancia Preditiva (PC) . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 55

5.2.2 Ordenada preditiva condicional (CPO) . . . . . . . . . . . . . . . . . . . . . . . . . 55

5.2.3 Probabilidade mais conservadora . . . . . . . . . . . . . . . . . . . . . . . . . . . . 56

5.2.4 Razao de densidades de Savage-Dickey . . . . . . . . . . . . . . . . . . . . . . . . . 57

5.3 Estudo Simulado . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 58

6 P-valor bayesiano 72

6.1 Medidas de discrepancia . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 73

6.2 Estudo Simulado . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 76

7 Selecao de modelos 83

7.1 Fator de Bayes Usual . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 83

7.2 Fator de Bayes fracionario . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 85

7.3 Regra de Decisao e Interpretacao . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 87

7.4 Estudo Simulado . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 88

8 Conclusoes e projetos futuros 93

A Condicionais Completas 95

A.1 Caso Gaussiano . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 95

A.2 Caso T-Student Multivariado . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 96

A.3 Caso GLG . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 97

7

A.4 Amostrador para os λ’s . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 98

B T-Student Multivariada 101

Lista de Tabelas

3.1 Simulacao dos dados (z) oriundos de uma distribuicao normal multivariada com seus res-

pectivos parametros (σ2,µ, φ, κ) . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 26

3.2 Contaminacao dos dados para cada cenario . . . . . . . . . . . . . . . . . . . . . . . . . . 27

3.3 Mediana a posteriori e quantis de 2,5% e 97,5% para os parametros do modelo gaussiano

no Cenario 1 . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 28

3.4 Mediana a posteriori e quantis de 2,5% e 97,5% para os parametros do modelo t student

multivariado para o Cenario 1. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 30

3.5 Mediana a posteriori e quantis de 2,5% e 97,5% para os parametros do modelo GLG para

o Cenario 1. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 33

4.1 Parametros fixados para o calculo da curva de influencia para as duas funcoes de covariancia 45

4.2 Valores da curtose como uma funcao do parametro responsavel pelo comportamento da

cauda ν do modelo GLG e comparados com os graus de liberdade νts da T-student. . . . 47

5.1 Tabela dos resıduos padronizados com respectivas probabilidades a posteriori pi(|ri| >

t|z) no Cenario 1 para os tres modelos propostos. Probabilidades a posteriori grandes

representam presenca de outliers na amostra. . . . . . . . . . . . . . . . . . . . . . . . . . 62

5.2 Tabela dos resıduos padronizados com respectivas probabilidades a posteriori pi(|ri| >

t|z) no Cenario 2 para os tres modelos propostos. Probabilidades a posteriori grandes

representam presenca de outliers na amostra. . . . . . . . . . . . . . . . . . . . . . . . . . 63

5.3 Tabela dos resıduos padronizados com respectivas probabilidades a posteriori pi(|ri| >

t|z), no Cenario 3 para os tres modelos propostos. Probabilidades a posteriori grandes

representam presenca de outliers na amostra. . . . . . . . . . . . . . . . . . . . . . . . . . 64

5.4 Variancia relativa a posteriori para algumas observacoes suspeitas como outliers no modelo

GLG. Observacoes classificadas como outliers, apresentam variancia relativa maiores que

as demais. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 64

5.5 Tabela das probabilidades multiplas a posteriori pij = p(|ri| > t3 e |rj | > t3|z) e cor-

relacao a posteriori ρij entre ri e rj , para cada modelo no Cenario 2. Probabilidades

multipla residuais a posteriori grandes, representam outliers na amostra. . . . . . . . . . . 65

5.6 Tabela das probabilidades multiplas a posteriori pij = p(|ri| > t3 e |rj | > t3|z) e cor-

relacao a posteriori ρij entre ri e rj , para cada modelo no Cenario 3. Probabilidades

multipla residuais a posteriori grandes, representam outliers na amostra. . . . . . . . . . . 65

5.7 Calculo do pci,cpoi, CPOpi e McP para algumas observacoes - observacoes destacadas

em negrito representam observacoes contaminadas. Probabilidades proximas de zero sao

classificadas como outliers . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 69

5.8 Densidade de Savage-Dickey para o modelo GLG no Cenario 2 e 3 em favor de λi para

algumas observacoes selecionadas. Observacoes em negrito representam observacoes con-

taminadas classificando-as como outliers. . . . . . . . . . . . . . . . . . . . . . . . . . . . 70

6.1 P-valor preditivo a posteriori (ppp) para os tres modelos propostos em seus respectivos

cenarios de acordo com as discrepancias (A), (A∗), (B) e (F) propostas no estudo. Proba-

bilidades proximas de zero indicam a nao adequacao do modelo aos dados. . . . . . . . . . 77

7.1 Calibragem do fator de Bayes segundo Jeffreys [1961]. . . . . . . . . . . . . . . . . . . . . 87

7.2 Calibragem do fator de Bayes na escala logarıtmica segundo Kass and Raftery [1995]. . . 88

7.3 Conclusao final para escolha do modelo. . . . . . . . . . . . . . . . . . . . . . . . . . . . . 88

7.4 Proporcao do 2 log do fator de Bayes usual B(z) do modelo gaussiano versus modelo TS. 89

7.5 Proporcao do 2 log do fator de Bayes Usual B(z) do modelo gaussiano versus modelo GLG. 89

7.6 Contaminacao de uma unica observacao classificada como outlier para 2 Log do fator de

Bayes Usual - modelo gaussiano versus modelo GLG. . . . . . . . . . . . . . . . . . . . . . 90

7.7 Contaminacao de uma unica observacao classificada como outlier para 2 Log do fator de

Bayes fracionario - modelo gaussiano versus modelo GLG, utilizando as constantes b. . . . 91

7.8 Propocao do 2log do fator de Bayes fracionario Bb(z) do modelo G versus modelo GLG,

de acordo com a constante b utilizada. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 92

10

Lista de Figuras

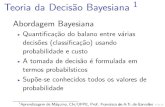

1.1 Densidade a posteriori de µ dado valores de z (i) Caso t-student com ν = 5 e (ii) Caso

Normal . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 16

2.1 Funcoes de correlacao Matern com seus respectivos valores de κ e φ. . . . . . . . . . . . . 21

2.2 Realizacao de uma funcao aleatoria gaussiana para a funcao de covariancia Matern com

parametros θ = (φ, κ) . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 22

2.3 Funcao de correlacao da classe Cauchy . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 22

3.1 Localizacao espacial de cada observacao de acordo com respectivo cenario. Os pontos

fixados com ∗ na cor vermelha representam os dados contaminados. O grafico (i) representa

o Cenario 1, (ii) Cenario 2 e (iii) Cenario 3. . . . . . . . . . . . . . . . . . . . . . . . 27

3.2 Convergencia das cadeias, histograma, media e autocorrelacao para os respectivos para-

metros do modelo gaussiano. A reta tracejada de cor vermelha no histograma representa

o valor verdadeiro, e a reta completa de verde representa a media a posteriori. . . . . . . . 29

3.3 Convergencia das cadeias, histograma, media e autocorrelacao para os respectivos para-

metros do modelo t-student multivariado. A reta tracejada na cor verde no histograma

representa o valor verdadeiro, e a reta completa na cor vermelha representa a media a

posteriori. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 32

3.4 Convergencia das cadeias, histograma, media e autocorrelacao para os respectivos para-

metros do modelo GLG. A reta tracejada na cor verde no histograma representa o valor

verdadeiro, e a reta completa na cor vermelha representa a media a posteriori. . . . . . . 35

3.5 Comportamento dos λ’s em cada cenario. Observacoes contaminadas sao destacadas em

verde e apresentam variancia relativa maior que as demais. . . . . . . . . . . . . . . . . . 36

4.1 (i) Funcoes de Densidade e (ii) Funcoes de Influencia para ν = 1 . . . . . . . . . . . . . . 38

4.2 Funcao de influencia da distribuicao t-student para respectivos graus de liberdade. A linha

tracejada na cor vermelha representa a funcao de influencia para distribuicao normal. . . 39

4.3 Funcao de Influencia univariada para o modelo gaussiano com z1 para funcao de covariancia

exponencial, para valores de φ. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 45

4.4 Funcoes de Influencia univariada para procesos gaussiano e respectivas funcoes de covariancia 46

4.5 Mapa de influencia para os processos Gaussiano, T-Student Multivariado (com νTS =

203 graus de liberdade) e GLG (ν = 0, 01 responsavel pelo comportamento da cauda),

alternando o valor do alcance. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 49

4.6 Mapa de influencia para os processos Gaussiano, T-Student Multivariado (com νTS = 5

graus de liberdade) e GLG (ν = 1 responsavel pelo comportamento da cauda), alternando

o valor do alcance. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 50

5.1 Box-Plots das distribuicoes a posteriori dos resıduos para as 30 observacoes nos modelos

(i) Gaussiano, (ii) T-Student Multivariado e (iii)GLG. As linhas pontilhadas representam

o intervalo (-2,2) para o caso gaussiano e as caixas de cor verde (pontos acima ou abaixo

do intervalo) representam os pontos contaminados em cada cenario. . . . . . . . . . . . . 60

5.2 Densidades preditivas para cada observacao dos modelos propostos para o Cenario 2 onde

a linha tracejada representa o dado observado zobsi , de acordo com os resultados obtidos

de pci. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 66

5.3 Densidades preditivas para cada observacao dos modelos propostos para o Cenario 3 onde

a linha tracejada representa o dado observado zobsi , de acordo com os resultados obtidos

de pci. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 67

6.1 Proporcao dos pontos acima da reta para atraves do calculo do p-valor baseado na medida

de discrepancia (A) na primeira linha e (A∗) segunda linha para o modelo gaussiano e

respectivos cenarios. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 78

6.2 Histograma e grafico de dispersao para a medida de discrepancia (A) para os modelos

propostos em seus respectivos cenarios. A reta vermelha em cada histograma representa o

valor observado. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 79

6.3 Histograma e grafico de dispersao para a medida de discrepancia (A∗) para os modelos

propostos em seus respectivos cenarios. A reta vermelha em cada histograma representa o

valor observado. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 80

6.4 Histograma e grafico de dispersao para a medida de discrepancia (B) para os modelos

propostos em seus respectivos cenarios. A reta vermelha em cada histograma representa o

valor observado. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 81

6.5 Histograma e grafico de dispersao para a medida de discrepancia (F ) para os modelos

propostos em seus respectivos cenarios. A reta vermelha em cada histograma representa o

valor observado. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 82

7.1 Densidades para os modelos G, T-Student e GLG,para observacoes nao contaminadas, tal

que `max − `t ∼ Gamma(α, 1) . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 89

7.2 Graficos do 2log(FBU) em favor do modelo gaussiano versus modelo GLG , utilizando o

estimador Shifted Gamma, quando observacao 15 e nao contaminada e contaminada. . . . 91

12

13

1 Introducao

Dados utilizados na analise estatıstica comumente apresentam algum tipo de referencia espaco-temporal.

Quando incorporado a dimensao espaco-temporal, e frequente a presenca de observacoes atıpicas, o que

pode causar algum tipo de vies na modelagem dos dados.

Considere interesse em modelar algum fenomeno no espaco como um processo estocastico

{Z(s) : s ∈ D} (1.1)

onde s varia continuamente em D e D representa o conjunto de todas as localizacoes s permitindo previsao

para qualquer ponto no espaco, tal que D ⊆ <d. Para qualquer colecao de localizacoes s1, . . . , sn com

cada si ∈ <2 e assumido que a distribuicao de Z = {Z(s1), . . . , Z(sn)} e uma Normal Multivariada

com media µ = (µ(s1), . . . , µ(sn)) e matriz de covariancia Σ com elementos Σij = Cov {Z(si);Z(sj)}.

Usualmente considera-se localizacao espacial s de dimensao dois, ou seja, utiliza-se latitude e longitude.

A estrutura de covariancia utilizada para os modelos propostos no presente estudo sao validas

em <d e sua validade depende da escolha da funcao de covariancia adotada. Adotaremos tres funcoes de

covariancia, da classe Matern, a Exponencial (como um caso especial da Matern) e a Cauchy Generalizada.

Estas estruturas sao validas em qualquer numeros de dimensoes segundo Stein [1999].

Se estamos interessados em modelar algum fenonomeno espacial, como por exemplo, chuva

de uma determinada regiao, algumas localizacoes podem apresentar maior variabilidade comparada as

outras localizacoes, vide que fenomenos naturais frequentemente apresentam dados fora do normal.

Modelos baseados na gaussianidade nao possuem um bom desempenho se o conjunto de

dados apresenta outliers, dados extremos ou regioes com maior variabilidade observacional. Desta forma,

modelos nao gaussianos sao preferıveis para tratar e acomodar outliers, ja que possuem caudas mais

pesadas e sao capazes de acomodar associacao espacial de forma a explicar melhor o comportamento dos

dados de maneira mais realista.

Recentemente na literatura, foram desenvolvidos alguns tipos de modelos nao-gaussianos

para processos espaciais, como De Oliveira and Short [1997] que utiliza transformacoes nao lineares de

campos amostrais, para acomodacao de outliers moderados. Ja Palacios and Steel [2006] propuseram um

modelo geoestatıstico para acomodar a nao gaussianidade, via misturas de escala, modelando somente

no espaco. Fonseca and Steel [2011] abordaram o uso de misturas em funcoes de covariancias no espaco

e no tempo.

Palacios and Steel [2006] mostraram ainda que embora o processo T-student seja um modelo

com caudas mais pesadas que o da Normal, ele nao possui a flexibilidade necessaria para modelar dados

georeferenciados, pois nao e capaz de capturar estrutura espacial. Outros autores sugerem entao o

modelo de mistura GLG (no ingles Gaussian Log-Gaussian) o qual e baseado em um processo de mistura

log-gaussiano, permitindo a modelagem em regioes com maior variancia. Este processo estocastico nos

permite identificar e acomodar observacoes consideradas outliers via mistura de escalas.

Com a finalidade de propor tecnicas de diagnosticos em modelos espaciais, utilizaremos tres

processos ao longo deste trabalho, o Gaussiano (G), o T-Student multivariado (TS) e o Gaussian Log

Gaussian (GLG),

O objetivo deste trabalho e estudar medidas de bondade do ajuste, analise de resıduos e

comparacao de modelos em modelos nao gaussianos para processos que variam de forma contınua no

espaco. O principal interesse e estudar a influencia do outlier na estimacao do parametro de interesse e

comparacao de modelo. Por exemplo, O’Hagan [1995] diz que um unico outlier pode dominar o calculo

e produzir um fator de Bayes totalmente enganoso. Em geral, algumas observacoes podem ser altamente

influentes para a estimacao dos parametros de um modelo mas de outro modelo nao.

Para isso iremos abordar os seguintes temas num contexto de modelos espaciais:

1. Utilizacao de funcoes de influencia, com objetivo de ver o quao uma observacao classificada como

outlier influencia na estimacao do parametro de interesse. Essa tecnica baseia-se na abordagem de

West [1984] e e generalizada para o contexto espacial.

2. Adota-se medidas de bondade de ajuste para selecao e comparacao de modelos mais robustos,

atraves de testes de hipoteses bayesiano, como o fator de Bayes usual (Kass and Raftery [1995]) e

fator de Bayes fracionario (O’Hagan [1995]), na crenca de que o fator de Bayes fracional fornece uma

forma de reduzir a sensiblidade do fator de Bayes usual perante os outliers. O p-valor bayesiano,

baseado na distribuicao preditiva tambem e utilizado para ver o quao adequado pode ser o modelo

na presenca de observacoes discrepantes.

3. Analises de resıduos bayesianos tambem sao estudados, como descrito em Chaloner and Brant [1988]

para deteccao de outliers. Os resıduos usuais utilizados em analise de regressao sao aplicados no

contexto espacial para deteccao de outliers. Alem disso, probabilidades a posteriori dos resıduos

tambem sao usadas para detectar outlier

4. Metodos de deteccao baseados na distribuicao preditiva sao estudados, como a concordancia pre-

ditiva (pc) proposto por Gelfand [1996], o calculo da preditiva condicional ordinal Gelfand [1996]

e uma medida de classificacao de outlier mais conservadora. O teste de Savage-Dickey, e utilizado

para o modelo GLG como um outro tipo de diagnostico para deteccao de outliers.

1.1 Estrutura e classificacao dos outliers

Define-se um outlier como uma observacao atıpica, ou seja, que apresenta um grande afastamento das

demais observacoes do conjunto amostral. Em estatıstica, a existencia dessas observacoes podem levar a

ma interpretacao dos resultados aplicados em toda a amostra.

E de extrema importancia saber como lidar com tal tipo de observacao, visto ser um problema

frequente em estatıstica. Diversos autores como A. and L.R [2011] mencionam alguns pontos relevantes

14

e citam alternativas ja aplicadas na literatura para solucionar este tipo de problema.

Uma das tecnicas sugeridas na literatura e a decisao da rejeicao ou nao dessa observacao,

tratando com um peso igual as demais observacoes presentes, com o uso de distribuicoes mais propı-

cias para o tratamento desse dado. Em nosso estudo, distribuicoes com caudas mais pesadas sao mais

favoraveis para tratar observacoes que apresentam comportamentos diferentes das demais na amostra.

O matematico deFinetti [1961] mostrou como a rejeicao de outliers poderia ocorrer natu-

ralmente no contexto bayesiano. De acordo com O’Hagan [1979], deFinetti [1961] descreveu como a

distribuicao a posteriori, dependendo sempre dos dados totais de forma que um modelo adequado seria

menos influenciado por valores atıpicos. Em particular, Neyman and Scott [1971] designaram que ha

situacoes em que os outliers nao devem ser tratados apenas como observacoes discrepantes, mas como

uma caracterıstica natural do processo de geracao de dados.

Neyman and Scott [1971] introduziram a classificacao de dois termos: outlier-prone, distri-

buicoes inclinada a valores extremos e outlier resistant, distribuicoes que resistem a valores atıpicos. Tais

termos sao inseridos em tipos de distribuicoes diferentes, como por exemplo, distribuicoes normais sao

classificadas como outlier resistant e distribuicoes t-student sao classificadas como outlier-prone .

A literatura sugere metodos bayesianos para resolver esse tipo de problema, atraves de um

modo automatico, sendo uma das alternativas o uso de distribuicoes com caudas pesadas. Uma forma

para geracao de tal tipo de distribuicao e realizada via de misturas de escalas da distribuicao Normal

como descrito em West [1984], A. and L.R [2011],Choy and Smith [1997] e Johnson and Geisser [1983].

1.2 Exemplo de motivacao

O exemplo apresentado a seguir e exposto em A. and L.R [2011] sob o enfoque bayesiano atraves da

modelagem de distribuicao com caudas pesadas via mistura de escalas, com intuito de tratar observacoes

extremas presentes no conjunto de dados.

Seja uma amostra contendo 6 observacoes, y = (1.5, 2.6, 0.3, 0.9, 2.2, 25.5), onde cada ob-

servacao yi tem distribuicao yi ∼ tν(µ, 1) independentes. Observe que a ultima observacao parece ser

um caso diferente das demais e nos questiona como trata-la quando comparada as demais observacoes

restantes. Considere a distribuicao t-student com densidade:

f(yi |µ, ν) ∝[1 +

(y − µ)2

ν

]− (ν+1)2

Portanto a funcao de log-verossimilhanca e dada por

15

log f(y |µ, ν) = log

n∏i=1

f(yi |µ, ν)

=

n∑i=1

log Γ

(ν + 1

2

)−

n∑i=1

log Γ(ν

2

)+

1

2log

(1

πν

)− (ν + 1)

2

n∑i=1

log

[1 +

(yi − µ)2

ν

]Considera-se uma priori uniforme para µ. A sexta observacao pode ser denotada por z e

uma distribuicao a posteriori de µ|y e z →∞.

A proposta e mostrar graficamente pelas curvas de densidade a posteriori de µ que se alte-

rarmos o valor de z, sendo z uma observacao da amostra y, a curva ira se mover suavemente, esbocando

uma nao influencia na estimacao do parametro µ.

Podemos comparar o caso da distribuicao t com a distribuicao Normal(µ, 1), novamente

considerando uma priori uniforme para µ. A funcao de log-verossimilhanca da Normal e dada por

logf(y |µ) =

n∑i=1

log

(1

2π

)− 1

2

n∑i=1

(yi − µ)2

−1 0 1 2 3 4

0.0

0.2

0.4

0.6

0.8

1.0

T − Student(ν, µ, 1)

µ

f

z=2z=10z=25.5z=200

−1 0 1 2 3 4

0.0

0.2

0.4

0.6

0.8

1.0

Normal(µ, 1)

µ

f

z=2z=5z=10z=20

(i) (ii)

Figura 1.1: Densidade a posteriori de µ dado valores de z (i) Caso t-student com ν = 5 e (ii) Caso Normal

Em relacao a distribuicao Normal(µ, 1) Figura (1.1) (ii), podemos observar que a alteracao

e o aumento do valor da sexta observacao (z) faz com que a curva se mova para a direita de forma

significativa indicando uma forte influencia na estimacao de µ. Por outro lado, isso nao ocorre com a

distribuicao t-student. Essa mudanca suave nas curvas e uma caracterıstica natural da distribuicao t,

como mostrado em Figura (1.1) (i). Baseado neste resultado, podemos concluir que distribuicoes com

caudas mais pesadas, relativamente se ajustam melhor a conjuntos de dados com observacoes aberrantes,

indicando menor influencia na estimacao do parametro de interesse. Assim, de fato, uma melhor maneira

de modelar um banco dados com tais conflitos e atraves do uso de distribuicoes com caudas pesadas, na

crenca de que isso ira fornecer um comportamento mais robusto na distribuicao a posteriori em resposta

aos outliers.

16

Acredita-se que essa influencia de observacoes atıpicas seja tambem importante num contexto

espacial, onde observacoes tendem a ser correlacionadas espacialmente. Esse tema sera abordado nesta

dissertacao.

1.3 Delineamento da dissertacao

A dissertacao esta organizada da seguinte forma. No Capıtulo 2, sao apresentados conceitos de modelagem

espacial, como por exemplo estacionariedade. Tambem sao apresentados os tres processos espaciais que

serao comparados ao longo do estudo, gaussiano, T-student multivarido e GLG, acrescentando suas

caracterısticas, vantagens e desvantagens. A escolha das funcoes de covariancia utilizadas no contexto

espacial tambem e exposta, bem como a utilizacao da inferencia bayesiana para estes modelos e para as

metodos adotados nos capıtulos seguintes.

No Capıtulo 3, e realizado a simulacao de um pequeno conjunto de dados, oriundos de uma

normal multivariada. Os dados sao contaminados em cenarios - nenhum, pouco, moderados outliers. Em

particular, estamos interessados em utilizar distribuicoes com caudas mais pesadas comparadas as da

normal atraves de mistura de escalas para acomodar a nao gaussianidade.

No Capıtulo 4, a funcao de influencia e estendida para o caso espacial, com a finalidade de

observar o quao influente pode ser uma observacao classificada ou nao como discrepante na estimacao de

um parametro de interesse. Mapas para as funcoes de influencia dos processo sao expostos para os tres

modelos.

No Capıtulo 5, sao estudados alguns metodos de diagnosticos bem estabelecidos na literatura

para deteccao de outliers, sendo estendido para o contexto espacial. A analise de resıduo bayesiana de

forma padronizada e descrito para os tres modelos espaciais considerados (Normal, T-Student e GLG).

Metodos de deteccao de outliers baseados na preditiva e teste de Savage-Dickey tambem sao estudados.

Alem disso, e proposto por mim dois metodos para detectar outliers baseados na preditiva: o p-valor para

a condicional preditivia ordinal, que pode ser visto como um p-valor de validacao cruzada e um p-valor

mais conservador na escolha de outliers.

No Capıtulo 6, e apresentado o p-valor bayesiano para cada cenario proposto no Capıtulo 3

com respectivos modelos, atraves de medidas de discrepancias que sao utilizadas como teste estatıstico

na inferencia classica.

Ja no Capıtulo 7, e estudado a comparacao e selecao de modelos atraves do fator de Bayes

usual e fator de Bayes fracional para a escolha de um melhor modelo que se adeque aos dados.

Por fim, no Capıtulo 8, e feito um breve resumo sobre os resultados da dissertacao e possıveis

trabalhos futuros.

17

18

2 Estatıstica espacial

2.1 Modelo Gaussiano

Os modelos para dados referenciados no espaco e no tempo sao recorrentemente utilizados em varias areas

tais como, meio ambiente, dados meterologicos, geologicos e saude. Neste contexto, podemos definir o

processo como descrito em (1.1) e

Z ∼ Normaln(µ, σ2Σ(θ)) (2.1)

Segundo Diggle and Ribeiro [2007], processos estocasticos do tipo gaussianos sao comumente

utilizados na pratica em modelos para dados geoestatısticos, ou seja, dados que assumem valores reais

para cada localizacao s ∈ D ⊆ <d podendo capturar um comportamento espacial de acordo com a

especificacao de sua estrutura de correlacao. Tal classe e matematicamente conveniente, mas a suposicao

e muito restritiva e os dados podem apresentar muitas vezes caracterısticas nao-gaussianas (Fonseca and

Steel [2011]).

A funcao de covariancia para o processo Z(s) e escrita da forma

C(s, s+ us) = Cov {Z(s);Z(s+ us)} (2.2)

onde C e uma funcao de covariancia valida em <d. Por exemplo, a funcao de covariancia para o modelo

Matern e valida em qualquer numero de dimensoes (Stein [1999]) e e utilizada para processos puramente

espaciais (ver em Banerjee et al. [2004], Palacios and Steel [2006]). A seguir, iremos tambem considerar

alguns conceitos como estacionariedade e isotropia.

O processo {Z(s) : s ∈ D} e dito ser estacionario, se sua esperanca nao depende dos pontos

de localizacao, ou seja, se µ(s) = µ, e uma constante para s e C(s, s+ us) = K(us), onde us representa

o vetor de diferenca.

O processo estacionario e isotropico se C(s, s+us) = K(||us||) onde || · || denota a distancia

euclidiana, ou seja, a covariancia entre os valores de Z(s) para qualquer duas localizacoes depende somente

da distancia entre eles.

2.2 Modelo de Mistura Espacial

Frequentemente dados apresentam algum tipo de observacao atıpica. E preciso saber lidar com esse tipo

de dado quando consideramos um processo no espaco, pois usualmente este tipo de dado pertencem a

sub-regioes que apresentam variancias observacionais grandes. Com isto, a distribuicao gaussiana torna-

se inadequada para este tipo de problema. E considerado processos nao-gaussianos, construıdo atraves

de modelos de mistura espacial com a finalidade de explicar o comportamento de caudas mais pesadas.

E de nosso interesse enfatizar a importancia dos modelos nao-gaussianos para processos que

variam continuamente no espaco.

Seja Z um processo escotastico definido para localizacoes s em alguma regiao espacial D ⊂

<d. Podemos escrever o modelo como:

Z(s) = xT (s)β + σZ(s)

λ1/2(s)+ τω(s) (2.3)

onde xT (s) representa as covariaveis do modelo com vetor de coeficientes β ∈ <k desconhecidos; Z(s)

e um processo gaussiano definido em s ∈ D, com um vetor de medias zero, e matriz de correlacao que

depende da distancia entre os pontos dada por Σ(θ), representando uma matriz de correlacao n× n, ou

seja, e a funcao de correlacao parametrizada pelo vetor θ = (φ, κ)T , tal que κ representa um parametro

de suavizacao e φ o parametro de decaimento. Um efeito pepita (do ingles nugget efect) dado por

ω(s) iid com media zero e matriz de covariancia τ2In, e inserido no modelo afim de permitir erros de

medida e variacao de pequena escala. Note que se τ2 = 0 havera a ausencia do efeito pepita no processo

{Z(s) : s ∈ D}.

Se definimos λ(s) 6= 1, teremos um processo nao gaussiano, onde a unica diferenca e que

neste caso temos um processo de mistura denotado por λ(s), tal que o processo {λ(s) : s ∈ D} e um

processo de mistura positivo espacialmente correlacionado, isto e, uma funcao unica da distancia us,

entre si e sj , do qual independe de Z(s) e do efeito pepita. Abaixo, sao apresentados dois modelos nao

gaussianos:

A) O caso em que a distribuicao de mistura λ(s) = λ e λ|ν ∼ Gama(ν2 ,

ν2

)marginalizando z com

respeito a λ temos um processo T-student multivariado dado por

z ∼ t− studentn(µ, ν, σ2Σ(θ) + τ2In) (2.4)

onde ν representa os graus de liberdade e o calculo da marginalizacao pode ser visto com maiores

detalhes no Apendice B. Tambem podemos escreve-lo como

z|β, σ2,θ, λ ∼ Normaln(Xβ, σ2λ−1Σ(θ) + τ2In) (2.5)

B) Palacios and Steel [2006] propoem a classe de modelos GLG, permitindo a modelagem em regioes

com maior variancia. A insercao da variavel λ afeta a variancia do processo permitindo que o

mesmo se torne mais flexıvel, realıstico e acomode heterocedasticidade espacial.

Em particular, uma variavel de mistura λ(s) ∈ <+ e atribuıda para cada observacao da amostra e

a distribuicao conjunta de z|Λ e dada por:

19

z|β, σ2, τ2, θ,Λ ∼ Normaln(Xβ, σ2(Λ−1/2Σ(θ)Λ−1/2) + τ2In

)(2.6)

tal que Λ = diag(λ1, . . . , λn). Ao longo deste estudo nao usaremos o incremento do efeito pepita,

considerando τ2 = 0. Integrando em λ temos um processo com caudas mais pesadas que a normal.

Queremos estar na situacao em que poderıamos acomodar esses outliers, o que pode ser

realizado via mistura de variaveis para cada localizacao. De forma geral podemos definir a distribuicao

de mistura adotado em Palacios and Steel [2006] como

ln(λ) = (ln(λ1), ln(λ2)), . . . , ln(λn)))T ∼ Normaln(−ν

21, νΣ(θ)

)(2.7)

onde 1 representa um vetor de un’s, correlacionamos os elementos de ln(λ) atraves da mesma matriz de

correlacao como em Z(s) e ν ∈ <+ e um parametro escalas introduzido na distribuicao de ln(λ) e tais

valores perto de zero levam inflacao da variancia.

Cada elemento da distribuicao de λ(s) seguira uma Log-Normal com media E(λ) = 1 e

variancia V ar(λ) = eν − 1.

O grande diferencial desde modelo apresentado por Palacios and Steel [2006], e permitir

que os parametros do qual estamos interessados sejam estimados de maneira mais adequada quando

deparados com observacoes conflitantes, pois este e capaz de acomodar heterocedasticidade espacial,

devido a mistura de escala atribuida para cada localizacao, o que nao acontece com o modelo gaussiano e

T-student multivariado, pois estes nao sao capazes de capturar heterocedasticidade espacial, visto que o

modelo gaussiano nao apresenta nenhum parametro responsavel pelo comportamento da cauda e no caso

T-student multivariado embora tenhamos este parametro, e utilizado uma unica mistura de escala para

todas as localizacoes, e esta mistura nao se torna adequada para acomodacao de observacoes atıpicas.

2.3 Classes de Covariancias

Dados geoestatısticos sao comumente baseados na teoria de processos aleatorios gaussianos e o principal

elemento e a funcao de correlacao. Se o campo e tambem isotropico, a funcao de correlacao so dependera

da distancia u. Assim, algumas funcoes de correlacao sao incluıdas neste estudo.

2.3.1 Classe Matern

Uma forma muito comum do comportamento empırico para a estrutura de covariancia estacionaria e que

a correlacao entre Z(si) e Z(sj) decresce como a distancia u = ||si − sj || cresce. E natural, portanto,

olhar para modelos cuja estrutura de correlacao teorica se comporta desta maneira. E esperado tambem

que diferentes aplicacoes possam exibir diferentes graus de suavizacao no processo espacial Z(s).

A famılia Matern de funcoes de correlacao satisfaz essas duas determinantes. E uma famılia

de dois parametros desconhecidos, dado por

20

ρ(u) ={

2k−1Γ (κ)}−1

(u

φ

)κKκ

(u

φ

), u ≥ 0, φ ≥ 0 (2.8)

onde Kκ(·) e a funcao de Bessel modificada de ordem κ, sendo que κ > 0 determina a suavizacao analıtica

do processo Z(s) e 1/φ > 0 representa o parametro de alcance com as dimensoes da distancia, ou seja, a

distancia no qual as observacoes estao espacialmente correlacionadas.

Note que, para κ = 0, 5, a funcao de correlacao Matern reduz-se a funcao de correlacao

exponencial, ρ(u) = exp(−uφ

). Por outro lado, quando κ → ∞, ρ(u) → exp

{−(uφ

)2}

, tambem e

chamado de funcao correlacao Gaussiana. A funcao de covariancia e dada por

C(u) = σ2{

2k−1Γ (κ)}−1

(u

φ

)κKκ

(u

φ

), u ≥ 0, φ ≥ 0 (2.9)

A classe Matern e valida para qualquer numero de dimensoes segundo Stein [1999]. Podemos

observar graficamente na figura (2.1) o que acontece quando mudamos os valores de φ e κ.

0.0 0.2 0.4 0.6 0.8 1.0

0.0

0.2

0.4

0.6

0.8

u

ρ(u)

k=0.5φ=0.25k=1.5φ=0.16k=2.5φ=0.13

Figura 2.1: Funcoes de correlacao Matern com seus respectivos valores de κ e φ.

A figura abaixo representa a realizacao de funcao aleatoria gaussiana com θ = (φ, κ), com

processo mais suaves.

21

κ = 0, 5 κ = 1, 0 κ = 2, 0

Figura 2.2: Realizacao de uma funcao aleatoria gaussiana para a funcao de covariancia Matern com

parametros θ = (φ, κ)

2.3.2 Classe Cauchy Generalizada

A funcao de covariancia e dada por

C(u) = σ2

{1 +

(u

φ

)κ}ψ/κ, (2.10)

onde u e a distancia euclidiana, φ > 0, κ ∈ (0, 2] e ψ > 0. Quando κ = 2, esta classe e conhecida como

modelo Cauchy. O parametro φ representa o decaimento, κ a suaviacao do processo e ψ e responsavel

pela dependencia de longo alcance. Como na funcao Matern esta funcao tambem e valida em todas as

dimensoes, ver Gelfand and MacEachern [2005].

Uma das vantagens da utilizacao desta classe de covariancia e a flexibilidade, pois permite

a modelagem de dependencia de memoria longa e tambem correlacao de lags curtos e intermediarios. Se

ψ ∈ (0, 1) entao processo e dito ter memoria longa.

0.0 0.2 0.4 0.6 0.8 1.0

0.5

0.6

0.7

0.8

0.9

1.0

u

ρ(u)

k=0.5φ=0.25k=1.5φ=0.16k=2.5φ=0.13

Figura 2.3: Funcao de correlacao da classe Cauchy

22

2.4 Inferencia bayesiana

Nesta secao um procedimento inferencial e proposto seguindo o ponto de vista bayesiano. Para maiores

detalhes sobre o metodo bayesiano ver Migon and Gamerman [1999].

Suponha que observamos z = (z1, . . . , zn), onde zi = z(si) para cada localizacao si, i =

1, . . . , n. Temos uma media µ = β0 + β1lati + β2longi e a matriz de covariancia expressa por Σ(θ), onde

θ = (φ, κ). Podemos escrever a verossimilhanca para os respectivos modelos como:

I. Modelo Gaussiano: LG(Φ; z) = fnN (z|µ, σ2Σ(θ)), onde Φ = (β, σ2,θ)

II. Modelo T-Student Multivariado: LTS(Φ; z) = fnTS(z|µ, ν, σ2Σ(θ)) , onde Φ = (β, σ2,θ, ν)

III. Modelo GLG: LGLG(Φ; z) = fnN (z|µ, σ2Λ−1/2Σ(θ)Λ−1/2), onde Φ = (β, σ2,θ,λ, ν)

e fnN (·|µ,Σ) denota uma Normal multivariada e fTSn(·|µ, ν,Σ) e segue uma distribuicao T-Student mul-

tivariada

2.4.1 Distribuicao a Priori

A distribuicao a priori nos da o conhecimento previo a respeito do parametro do qual estamos interessados

em estudar antes de observar um conjunto de dados. Elicitar prioris nao e facil, pois temos que juntar

conhecimentos que o pesquisador acredita que seja viavel transformando este conhecimento em uma

distribuicao de probabilidade.

Se temos algum conhecimento previo do parametro de interesse, podemos utiliza-lo para

espeficicar a distribuicao a priori, caso contrario, precisamos recorrer a outros metodos, como por exemplo

utilizar prioris conjugadas ou nao informativas, procedendo uma analise bayesiana mais simples.

As prioris apresentadas a seguir foram baseadas no artigo de Palacios and Steel [2006] e

Fonseca et al. [2008] no qual tentam induzir propriedades razoaveis para um processo de elicitacao mais

cuidadoso.

• Distribuicao a priori para Modelo Gaussiano

Para o modelo gaussiano, nao teremos o incremento do efeito pepita (τ2 = 0), ou seja, os

locais de amostragem foram suficientemente proximos para detectar a variabilidade espacial da variavel

de estudo e o parametro de suavizacao κ e fixado. A distribuicao a priori sera contınua com uma funcao

de densidade da forma

π(β, σ2,θ) = π(β)π(σ2)π(θ) (2.11)

Em sequencia e descrito a escolha segundo Palacios and Steel [2006] para as distribuicoes a

priori no modelo gaussiano.

Priori para β: β ∼ Nn(0, c1In)

23

Priori para σ2: σ2 ∼ GamaInversa(a, b)

Priori para φ: φ ∼ Gama (1, c/med(us)), tal que med representa a mediana da distancia us.

• Distribuicao a priori para Modelo T-Student Multivariado

Para o modelo t-student multivariado, nao teremos o incremento do efeito pepita, ou seja, os

locais de amostragem foram suficientemente proximos para detectar a variabilidade espacial da variavel

de estudo e o parametro de suavizacao κ e fixado. A distribuicao a priori sera contınua com uma funcao

de densidade da forma

π(β, σ2,θ, ν) = π(β)π(σ2)π(θ)π(ν) (2.12)

Em sequencia e descrito a escolha segundo Palacios and Steel [2006] e Fonseca et al. [2008]

para as distribuicoes a priori no modelo T-Student multivariado.

Priori para β: β ∼ Nn(0, c1In)

Priori para σ2: σ2 ∼ GamaInversa(a, b)

Priori para φ: φ ∼ Gama (1, c/med(us))

Priori para ν : π(ν) ∝(

νν+3

)1/2 {ψ′(ν2

)− ψ′

(ν+1

2

)− 2(ν+3)

ν(ν+1)2

}1/2

, priori independente (Fonseca et al.

[2008])

em que ψ′(a) = dψ(a)da representa a funcao Trigama.

• Distribuicao a priori para Modelo GLG

Para o modelo GLG, nao teremos o incremento do efeito pepita, ou seja, os locais de amos-

tragem foram suficientemente proximos para detectar a variabilidade espacial da variavel de estudo e o

parametro de suavizacao κ e fixado. A distribuicao a priori sera contınua com uma funcao de densidade

da forma

π(β, σ2,θ, ν) = π(β)π(σ2)π(θ)π(ν) (2.13)

Em sequencia e descrito a escolha segundo Palacios and Steel [2006] para as distribuicoes a

priori no modelo GLG.

Priori para β: β ∼ Nn(0, c1In)

Priori para σ2: σ2 ∼ GamaInversa(a, b)

Priori para ν: ν ∼ GIG(ζ, δ, ι) ou ν ∼ Gama(c2, c3)

Priori para φ: φ ∼ Gama (1, c4/med(us))

24

2.4.2 Distribuicao a posteriori e distribuicao preditiva

Dado a funcao de verossimilhanca e a distribuicao a priori para o vetor de parametros Φ, para qualquer

inferencia e decisao a respeito de Φ temos que encontrar a densidade a posteriori utilizando o teorema

de Bayes sendo definida por

Teorema 2.4.1 (Distribuicao a Posteriori). A distribuicao a posteriori do vetor Φ e calculada atraves

do Teorema de Bayes, da forma

p(Φ|z) =L(Φ; z)π(Φ)∫L(Φ; z)π(Φ)dΦ

(2.14)

Para obter o denominador, ou seja, a distribuicao preditiva para o modelo de interesse

calcula-se

p(zrep|z) =

∫p(zrep|Φ)p(Φ|z)dΦ (2.15)

A equacao (2.15) sera bastante utilizada ao longo do trabalho, para o calculo das observacoes

futuras comparadas com os valores observados, verificar se uma observacao pode ser classificada como

outlier, calculo do p-valor bayesiano para o modelo e tambem na aplicacao do fator de Bayes (usual e

fracionario).

Como a posteriori do vetor parametrico Φ dificilmente possuiu uma forma analitica co-

nhecida, recorremos a utilizacao de metodos de simulacao estocastica via MCMC para obtermos uma

aproximacao da distribuicao a posteriori dos parametros. De forma mais especıfica adotamos o metodo

de Gibbs Sampler com passos de Metropolis-Hastings, para amostrar das condicionais completas. Para

maiores detalhes destes metodos ver Gamerman [1997], Robert and Casella [1999].

O calculo das condicionais completas para os modelos propostos acima sao expostas no

Apendice A, bem como a construcao do amostrador para λ.

25

26

3 Exemplo simulado e contaminacao de dados

Considere o caso em que Z(s) e um processo definido para localizacoes s em alguma regiao espacial

D ∈ <d. Podemos definir o modelo como

Z(s) = x(s)Tβ + σZ(s)

λ1/2(s)

O objetivo e mostrar a influencia das observacoes discrepantes em um processo gaussiano,

comparado com um processo nao-gaussiano como descrito anteriormente, pois outliers podem ser definidos

como observacoes pertencentes a uma determinada sub-regiao com variancia observacional grande.

Neste exemplo, foram simulados n = 30 pontos para latitute e longitude

Tabela 3.1: Simulacao dos dados (z) oriundos de uma distribuicao normal multivariada com seus respec-

tivos parametros (σ2,µ, φ, κ)

7,466 7,435 5,980 5,643 8,486 7,478 7,633 6,607 8,135 6,174

5,352 6,247 7,192 7,538 8,549 7,817 6,770 5,347 5,668 6,998

7,209 7,481 4,573 7,703 7,218 5,854 7,922 7,168 8,169 7,940

Definimos o modelo como em (2.3) para (λ(s) = 1 e ausencia de efeito pepita), simulando

z sendo oriundos de uma distribuicao fN (µ, σ2Σ(θ)), tal que µ(s) = β0 + β1lati + β2longi e matriz de

covariancia σ2Σ(θ) = Σ, e latitude (lat) e longitude (long) representam as covariaveis do modelo. Esta

simulacao foi divida em 3 cenarios e apresentado na tabela (3.2)

Para simulacao desses dados, fixamos valores iniciais para β0 = 6, 716, β1 = 2, 7, β2 = −1, 808

- para o calculo da media µ, σ = 1, φ = 0, 61, κ = 0, 5 – para o calculo da matriz de covariancia Σ, sendo

os dois ultimos parametros da funcao da matriz de correlacao Matern, do vetor θ. A partir do dado

verdadeiro (Cenario 1), foram contaminados os demais cenarios. Gostarıamos de analisar como os

dados se comportam na presenca de outliers.

Segundo West [1984] modelos normais contaminados sao uteis para caracterizar observacoes

discrepantes e mudancas na estrutura de series temporais em modelos lineares dinamicos. Utilizaremos

a mesma ideia para analise de dados contaminados em um contexto espacial.

Tabela 3.2: Contaminacao dos dados para cada cenario

Cenario 1 Sem presenca de outliers nos dados

Cenario 2 Com presenca de fracos outliers: foram contaminados 3 pontos

(observacoes 1,6,20)

Cenario 3 Com presenca de moderados outliers: foram contaminados 8 pontos

(observacoes 1,6,20,15,30,16,13,29)

As contaminacoes foram realizadas com intuito de investigar o comportamento de varios

metodos de diagnostico na identificacao de observacoes que seriam outliers. Para o Cenario 2, seleci-

onamos 3 observacoes aleatoriamente de tal forma que as observacoes 1 e 20 foram contaminadas por

adicao de um incremento aleatorio utilizando uma Uniforme(1; 3, 5) vezes um desvio padrao para cada

observacao e a observacao 6 foi contaminada por adicao de um incremento aleatorio Uniforme(1; 2, 5)

vezes um desvio padrao para todas as locacoes espaciais, classificados como fracos outliers.

Da mesma forma, o Cenario 3, classificado como moderado outliers, as 8 observacoes

foram selecionadas aleatoriamente de forma que as observacoes 1, 13, 15, 16, 20, 30 foram contaminadas

por adicao de um incremento aleatorio atraves da Uniforme(1; 3, 5), a observacao 6 adicionada por

Uniforme(1; 2, 5) e a observacao 29 adicionando uma Uniforme(1; 6, 5) vezes um desvio padrao para

todas as localizacoes espaciais. A Figura (3.1) mostra o mapa das contaminacoes em cada cenario.

long

lat

0.0 0.2 0.4 0.6 0.8 1.0

0.0

0.2

0.4

0.6

0.8

1.0

long

lat

0.0 0.2 0.4 0.6 0.8 1.0

0.0

0.2

0.4

0.6

0.8

1.0

long

lat

0.0 0.2 0.4 0.6 0.8 1.0

0.0

0.2

0.4

0.6

0.8

1.0

(i) (ii) (iii)

Figura 3.1: Localizacao espacial de cada observacao de acordo com respectivo cenario. Os pontos fixados

com ∗ na cor vermelha representam os dados contaminados. O grafico (i) representa o Cenario 1, (ii)

Cenario 2 e (iii) Cenario 3.

3.1 Estimacao dos parametros

Nesta secao apresentaremos a estimacao dos parametros para os tres processos propostos somente para

os dados originais, ou seja, com ausencia de contaminacao, com o intuito de verificar a convergencia do

27

vetor de parametros de cada processo.

3.1.1 Modelo Gaussiano - Classe Matern

Inicialmente iremos avaliar o modelo proposto utilizando os respectivos cenarios, atraves dos dados simu-

lados oriundos de uma Normal Multivariada com media µ = β0 + β1lati + β2longi e com estrutura de

covariancia da classe Matern com κ = 0, 5 fixo. Os dados consistem em 30 locacoes espaciais, com o vetor

de parametros Φ = (µ, σ2, φ) . Foram utilizadas as mesmas distribuicoes a priori propostas no Capıtulo

2, onde os valores dos parametros de cada priori foram selecionados de tal forma que as distribuicoes a

priori fossem vagas, ou seja, pouco informativas.

As amostras a posteriori sao obtidas utilizando M = 50000 iteracoes ,um burn-in de 1000

e lag de 50 iteracoes. A convergencia dos parametros e histogramas a posteriori sao mostradas nas

figuras (3.2), com valor verdadeiro e a curva da priori. A tabela (3.3) mostra o resumo dos parametros a

posteriori, com mediana e intervalo de credibilidade para o Cenario 1.

Tabela 3.3: Mediana a posteriori e quantis de 2,5% e 97,5% para os parametros do modelo gaussiano no

Cenario 1

Parametro Mediana (2, 5%; 97, 5%)

β0 = 6, 716 6,543 (4, 685; 8, 512)

β1=2,700 2,328 (0, 344; 4, 739)

β2=-1,808 -1,358 (−3, 340; 0, 659)

σ2 = 1, 0 1,001 (0, 941; 1, 068)

φ = 0, 61 0,588 (0, 327; 0, 935)1Taxa de aceitacao para φ igual a 0,239

28

0 200 600 1000

46

810

β0 β0

Den

sity

4 6 8 10

0.0

0.1

0.2

0.3

0.4

0 200 600 1000

6.0

6.2

6.4

6.6

0 5 10 20 30

0.0

0.2

0.4

0.6

0.8

1.0

Lag

AC

F

autocorrelação beta0

0 200 600 1000

02

46

β1 β1

Den

sity

−2 0 2 4 6

0.00

0.10

0.20

0.30

0 200 600 1000

2.5

3.0

3.5

0 5 10 20 30

0.0

0.2

0.4

0.6

0.8

1.0

Lag

AC

F

autocorrelação beta1

0 200 600 1000

−5

−3

−1

01

2

β2 β2

Den

sity

−4 −2 0 2

0.00

0.10

0.20

0.30

0 200 600 1000

−1.

6−

1.2

−0.

8−

0.4

0 5 10 20 30

0.0

0.2

0.4

0.6

0.8

1.0

LagA

CF

autocorrelação beta2

0 200 600 1000

0.90

1.00

1.10

σ2 σ2

Den

sity

0.90 1.00 1.10

02

46

810

0 200 600 1000

1.00

01.

010

0 5 10 20 30

0.0

0.2

0.4

0.6

0.8

1.0

Lag

AC

F

autocorrelação sigma2

0 200 600 1000

0.2

0.4

0.6

0.8

1.0

1.2

φ φ

Den

sity

0.2 0.6 1.0

0.0

0.5

1.0

1.5

2.0

2.5

0 200 600 1000

0.55

0.65

0.75

0 5 10 20 30

0.0

0.4

0.8

Lag

AC

F

autocorrelação phi

Figura 3.2: Convergencia das cadeias, histograma, media e autocorrelacao para os respectivos parametros

do modelo gaussiano. A reta tracejada de cor vermelha no histograma representa o valor verdadeiro, e a

reta completa de verde representa a media a posteriori.

29

3.1.2 Modelo T-Student multivariado

Como no modelo gaussiano, iremos fixar o valor de κ = 0, 5 para funcao de covariancia da classe Matern,

como um caso particular. Os dados consistem em 30 localizacoes espaciais, com o vetor de parametros

Φ = (µ, σ2, φ, ν) . Foram utilizadas as mesmas distribuicoes a priori propostas no Capıtulo 2, onde os

valores dos parametros de cada priori foram selecionados de tal forma que as distribuicoes a priori fossem

vagas, ou seja, pouco informativas.

Amostras a posteriori sao obtidas utilizando M = 50000 iteracoes, com um burn-in de 1000 e lag de

50 iteracoes. A convergencia da cadeia dos parametros sao mostradas nas figuras , para o cenario 1. A

tabela (3.4) mostra o resumo a posteriori de cada parametro para o Cenario 1.

Tabela 3.4: Mediana a posteriori e quantis de 2,5% e 97,5% para os parametros do modelo t student

multivariado para o Cenario 1.

Parametro Mediana Intervalo de Credibilidade

β0 = 6, 716 7,000 (4, 681; 8, 614)

β1=2,700 2,000 0, 223; 4, 493)

β2=-1,808 -1,475 (−3, 424; 0, 612)

σ2 = 1, 0 1,003 (0, 940; 1; 070)

φ = 0, 61 0,579 (0, 241; 1, 495)

ν 7,721 (0, 0121; 39, 797)1Taxa de aceitacao para φ igual a 0,260

2Taxa de aceitacao para ν igual a 0,358

30

0 200 600 1000

46

810

β0 β0

Den

sity

2 4 6 8 10

0.0

0.1

0.2

0.3

0 200 600 1000

6.0

6.2

6.4

6.6

6.8

0 5 10 20 30

0.0

0.2

0.4

0.6

0.8

1.0

Lag

AC

F

autocorrelação beta0

0 200 600 1000

−2

02

46

β1 β1

Den

sity

−2 0 2 4 6

0.00

0.10

0.20

0.30

0 200 600 1000

1.2

1.6

2.0

2.4

0 5 10 20 30

0.0

0.2

0.4

0.6

0.8

1.0

Lag

AC

F

autocorrelação beta1

0 200 600 1000

−6

−4

−2

02

β2 β2

Den

sity

−6 −4 −2 0 2

0.00

0.10

0.20

0.30

0 200 600 1000

−1.

6−

1.2

−0.

8

0 5 10 20 30

0.0

0.2

0.4

0.6

0.8

1.0

LagA

CF

autocorrelação beta2

0 200 600 1000

0.95

1.00

1.05

1.10

σ2 σ2

Den

sity

0.90 1.00 1.10

02

46

810

12

0 200 600 1000

0.98

00.

990

1.00

0

0 5 10 20 30

0.0

0.2

0.4

0.6

0.8

1.0

Lag

AC

F

autocorrelação sigma2

31

0 200 600 1000

0.2

0.4

0.6

0.8

1.0

φ φ

Den

sity

0.2 0.6 1.0

0.0

1.0

2.0

3.0

0 200 600 1000

0.52

0.56

0.60

0.64

0 5 10 20 30

0.0

0.2

0.4

0.6

0.8

1.0

Lag

AC

F

autocorrelação phi

0 200 600 1000

020

4060

80

Index

nu.s

ampl

e

nu.sample

Fre

quen

cy

0 20 40 60 80

010

030

050

0

0 200 600 1000

510

15

0 5 10 20 30

0.0

0.2

0.4

0.6

0.8

1.0

Lag

AC

F

autocorrelação nu

Figura 3.3: Convergencia das cadeias, histograma, media e autocorrelacao para os respectivos parametros

do modelo t-student multivariado. A reta tracejada na cor verde no histograma representa o valor

verdadeiro, e a reta completa na cor vermelha representa a media a posteriori.

3.1.3 Modelo GLG - Classe Matern

Fixa-se novamente o valor do parametro de suaviacao κ = 0, 5 para funcao de covariancia da classe Matern,

como um caso particular. Os dados consistem em 30 locacoes espaciais, com o vetor de parametros

Φ = (µ, σ2, φ, ν,λ) . Foram utilizadas as mesmas distribuicoes a priori propostas no Capıtulo 2, onde os

valores dos parametros de cada priori foram selecionados de tal forma que as distribuicoes a priori fossem

vagas, ou seja, pouco informativas.

Amostras a posteriori sao obtidas utilizando M = 50000 iteracoes, com um burn-in de 1000 e lag de 50

iteracoes. A convergencia da cadeia dos parametros sao mostradas nas figuras (3.4), para o Cenario 1. O

histograma das distribuicoes a posteriori para os respectivos parametros sao mostrados na figura (3.4).

A tabela (3.5) mostra o resumo a posteriori de cada parametro para o Cenario 1.

32

Tabela 3.5: Mediana a posteriori e quantis de 2,5% e 97,5% para os parametros do modelo GLG para o

Cenario 1.

Parametro Mediana Intervalo de Credibilidade

β0 = 6, 716 6,374 (4, 376; 8, 353)

β1=2,700 2,365 (0, 167; 4, 881)

β2=-1,808 -1,387 (−3, 775; 0, 948)

σ2 = 1, 0 1,006 (0, 943; 1, 068)

φ = 0, 61 0,479 (0, 301; 0, 760)

ν 0,053 (0, 003; 0, 281)1Taxa de aceitacao para φ igual a 0.235

2Taxa de aceitacao para ν igual a 0.306

33

0 200 600 1000

34

56

78

9

β0 β0

Den

sity

3 4 5 6 7 8 9

0.0

0.1

0.2

0.3

0.4

0 200 600 1000

6.2

6.6

7.0

0 5 10 20 30

0.0

0.2

0.4

0.6

0.8

1.0

Lag

AC

F

autocorrelação beta0

0 200 600 1000

02

46

β1 β1

Den

sity

0 2 4 6

0.00

0.10

0.20

0.30

0 200 600 1000

1.5

2.0

2.5

3.0

0 5 10 20 30

0.0

0.4

0.8

Lag

AC

F

autocorrelação beta1

0 200 600 1000

−6

−4

−2

02

β2 β2

Den

sity

−6 −4 −2 0 2

0.00

0.10

0.20

0.30

0 200 600 1000

−1.

8−

1.4

−1.

0

0 5 10 20 30

0.0

0.2

0.4

0.6

0.8

1.0

LagA

CF

autocorrelação beta2

0 200 600 1000

0.90

0.95

1.00

1.05

1.10

σ2 σ2

Den

sity

0.90 1.00 1.10

02

46

810

0 200 600 1000

0.96

0.98

1.00

0 5 10 20 30

0.0

0.2

0.4

0.6

0.8

1.0

Lag

AC

F

autocorrelação sigma2

34

0 200 600 1000

0.4

0.6

0.8

1.0

φ φ

Den

sity

0.4 0.6 0.8 1.0

01

23

0 200 600 1000

0.40

0.45

0.50

0 5 10 20 30

0.0

0.2

0.4

0.6

0.8

1.0

Lag

AC

F

autocorrelação phi

0 200 600 1000

0.0

0.1

0.2

0.3

0.4

Index

nu.s

ampl

e

nu.sample

Fre

quen

cy

0.0 0.2 0.4

010

020

030

040

0

0 200 600 1000

0.06

0.10

0.14

0 5 10 20 30

0.0

0.2

0.4

0.6

0.8

1.0

Lag

AC

F

autocorrelação nu

Figura 3.4: Convergencia das cadeias, histograma, media e autocorrelacao para os respectivos parametros

do modelo GLG. A reta tracejada na cor verde no histograma representa o valor verdadeiro, e a reta

completa na cor vermelha representa a media a posteriori.

3.2 Comportamento dos λ’s no modelo GLG

E apresentado pelas figuras (3.5) para cada cenario o comportamento do parametro λ no modelo GLG

em relacao as observacoes. Este parametro consegue capturar outliers por meio da variancia de cada

observacao. Os outliers podem ser classificados como tais se possuem variancias maiores em relacao as

outras observacoes.

A proposta para os λi, i = 1, . . . , n no MCMC e construıda dividindo as observacoes em 4

blocos (regioes), definidos pela posicao no domınio espacial. As regioes foram divididas e contaminadas

de acordo com a figura (3.5), que apresenta o box-plot das variancias relativas σ2

λ para cada localizacao.

Observa-se que locacoes que foram contaminadas apresentam uma variancia relativa maior que as demais

locacoes nao contaminadas. Com isso, podemos afirmar que o processo de mistura consegue identificar

observacoes discrepantes na amostra.

35

Cenario 1

long

lat

0.0 0.2 0.4 0.6 0.8 1.0

0.0

0.2

0.4

0.6

0.8

1.0

1

2 3

4

5

6

7

8

9

1011

12

13

14

15

1617

1819

20

21

22

23

24

2526

27

2829

30

1 4 7 11 15 19 23 27

0.6

0.8

1.0

1.2

1.4

1.6

1.8

observações

σ2λ i

Cenario 2

long

lat

0.0 0.2 0.4 0.6 0.8 1.0

0.0

0.2

0.4

0.6

0.8

1.0

1

2 3

4

5

6

7

8

9

1011

12

13

14

15

1617

1819

20

21

22

23

24

2526

27

2829

30

1 20

6

1 4 7 11 15 19 23 27

02

46

8

observações

σ2λ i

Cenario 3

long

lat

0.0 0.2 0.4 0.6 0.8 1.0

0.0

0.2

0.4

0.6

0.8

1.0

1

2 3

4

5

6

7

8

9

1011

12

13

14

15

1617

1819

20

21

22

23

24

2526

27

2829

30

1 20

6

15

2930

16

1 4 7 11 15 19 23 27

02

46

810

1214

observações

σ2λ i

Figura 3.5: Comportamento dos λ’s em cada cenario. Observacoes contaminadas sao destacadas em verde

e apresentam variancia relativa maior que as demais.

36

37

4 Funcoes de influencia espaciais

Nesta secao abordaremos um instrumento que permite um melhor entendimento sobre o comportamento

de uma distribuicao ou modelo perante os dados. Nas analises a seguir a funcao de influencia sugere

como se comporta um estimador quando mudamos uma observacao da amostra, baseada no conjunto dos

dados.

4.1 Funcao de influencia

A funcao de influencia permite analisar como o conjunto de dados sao tratados pela estimacao em uma

determinada distribuicao de interesse.

Sob o paradigma bayesiano o calculo da funcao de influencia e visto com maiores detalhes em

West [1984]. A funcao de influencia e calculada a partir da distribuicao escore a posteriori do parametro

no qual estamos interessados e escrita como

∂

∂µlogp(µ, ν|y) =

∂

∂µlogπ(µ) +

n∑i=1

g(yi − µ) (4.1)

onde a expressao em (4.1) e a funcao escore a posteriori e g(ε) = − ∂∂εp(ε) e a funcao de influencia e

ε = yi − µ. Para (4.1) o efeito que a observacao yi tem sobre a funcao escore e determinada pela funcao

de influencia g.

Apresentado o caso da tν(µ, λ) no exemplo de motivacao (1.2) do Capıtulo 1, podemos

calcular a sua funcao de influencia, ja que o proposito e avaliar se a observacao yi influencia ou nao na

estimacao do parametro µ. Para isso, seja o parametro de escala σ2 = 1, conhecido. Sua distribuicao a

posteriori e dada por

p(µ, ν|yi) ∝ f(yi|µ, ν)π(µ)

Aplicando o log na distribuicao a posteriori e derivando em relacao a µ:

logp(µ, ν|yi) = c+ logf(yi|µ, ν) + logπ(µ) + logπ(ν)

∂

∂µlogp(µ, ν|yi) =

1

π(µ)π′(µ) +

(ν + 1

2

)(1

1 + (yi−µ)2

ν

)(2

(yi − µ)

ν

)

Entao se temos as observacoes y1, . . . , yn a funcao de influencia da t-student sera dada por

gt =

(ν + 1

2

) n∑i=1

(1

1 + (yi−µ)2

ν

)(2

(yi − µ)

ν

)

e entao

gt(ε) =

(ν + 1

2

) n∑i=1

(1

1 + ε2

ν

)(2ε

ν

)

Para o caso da distribuicao Normal com parametros µ e σ2 temos que a funcao de influencia

e dada por:

gN (ε) =

n∑i=1

(yi − µ)

=

n∑i=1

ε

funcao de influencia da forma linear (y − µ).

Abaixo segue as curvas de densidade e suas respectivas funcoes de influencia para a tν(µ, ν, 1)

e Normal(µ, 1)

−4 −2 0 2 4

0.0

0.1

0.2

0.3

0.4

0.5

Densidade

Student's tNormal

−20 −10 0 10 20

−1.

5−

1.0

−0.

50.

00.

51.

01.

5

Função de Influência

y

g(ε)

Student's tNormal

(i) (ii)

Figura 4.1: (i) Funcoes de Densidade e (ii) Funcoes de Influencia para ν = 1

38

−20 −10 0 10 20

−3

−2

−1

01

23

y

g(ε)

ν=1ν=5ν=20

ν=1ν=5ν=20

ν=1ν=5ν=20

Figura 4.2: Funcao de influencia da distribuicao t-student para respectivos graus de liberdade. A linha

tracejada na cor vermelha representa a funcao de influencia para distribuicao normal.

Conforme aumentamos um valor de y na t-student, a influencia em relacao a µ diminui, o

que nao acontece para o caso gaussiano. Note que se aumentamos o valor de y a influencia permanece

alta sobre a estimacao do parametro. Veja ainda que ν o parametro representado pelos graus de liberdade

tambem influencia na estimacao do parametro de interesse e quanto maior e o valor dos graus de liberdade

mais a influencia da t-student se assemelhara com a influencia da normal. Temos mais uma evidencia

que distribuicoes com caudas mais pesadas sao favoraveis para tratar dados contaminados.

4.2 Caso Espacial

Apresentado o caso nao-espacial no qual conseguimos representar a curva de influencia de µ de acordo

com a distribuicao de interesse, a ideia entao e novamente representar o quao influenciavel e o parametro

na presenca de dados atıpicos, por meio de modelos espaciais.

De acordo com a proposta de West [1984] iremos generalizar as funcoes de influencia espaciais

para os dois modelos: Gaussiano e Nao Gaussiano.

4.2.1 Caso Gaussiano

Inicialmente considere o caso onde µ e um escalar. De forma geral suponha que temos z|µ, σ2,θ ∼

fN (µ, σ2Σ(θ)). Para σ2 = 1 e θ conhecidos temos o log da sua densidade

logL(µ; z) ∝ −1

2

{(z− µ1n)TΣ−1(z− µ1n)

}O calculo da funcao escore a posteriori e dado por

39

dlogp(µ|z)

dµ=

dlogπ(µ)

dµ+dlogL(µ; z)

dµ

=1

π(µ)π′(µ)− 1

2

{1TnΣ−1z− zTΣ−11n + 2µ1TnΣ−11n

}=

1

π(µ)π′(µ) +

{1TnΣ−1z− µ1TnΣ−11n

}=

1

π(µ)π′(µ) +

{1TnΣ−1(z− µ1n)

}

Denotado por C = Σ−1, representando a matriz de precisao e assim temos

dlogp(µ|z)

dµ=

1

π(µ)π′(µ) + (C·1, . . . , C·n)(z− µ1n)︸ ︷︷ ︸

gG

, k = 1, . . . , n

onde C·k representa a soma dos elementos de cada linha da coluna k, tal que gG e a funcao de influencia

para o processo gaussiano para o caso geral de West [1984]. Gostarıamos de ver como uma determinada

observacao (que pode ser ou nao discrepante) influencia na estimacao do parametro de interesse. Baseado

nesta fato, chegamos a seguinte proposicao

Proposicao 4.2.1. Se para a observacao k, onde z = (zk, z(−k)) representa o vetor das observacoes zk e

as demais observacoes da amostra z(−k) diferentes de zk, a funcao de influencia para o processo gaussiano

pode ser representada atraves de

gG(ε) = C·k (zk − µ)︸ ︷︷ ︸εk

+∑j 6=k

C·j (zj − µ)︸ ︷︷ ︸εj

(4.2)

A primeira parte de (4.2) representa a influencia da observacao k e a outra parte a influencia das demais

observacoes. Para o caso em que C·k = 1, k = 1, . . . , n retornaremos para o caso i.i.d. de West [1984] dada

pela equacao (4.1), onde todas as observacoes apresentam o mesmo comportamento, ou seja, independente

e identificamente distribuıdas.

4.2.2 Caso T-Student Multivariado

Inicialmente considere o caso onde µ e um escalar. Suponha que temos z ∼ t − studentn(µ, ν, σ2Σ(θ)).

Para σ2 = 1 e θ conhecidos e ν um valor fixo , temos o logaritmo da densidade dado por

logL(µ, ν; z) ∝ −(ν + n

2

)log

{1 +

(z− µ1n)TΣ−1(z− µ1n)

ν

}O calculo da funcao escore a posterior e dado por

40

dlogp(µ, ν|z)

dµ=

dlogπ(µ)

dµ+dlogL(µ, ν; z)

dµ

=1

π(µ)π′(µ)−

(ν + n

2

)×

(1

1 + (z−µ1n)TΣ−1(z−µ1n)ν

)

×(

1 +1TnΣ−1z− zTΣ−11n + 2µ1TnΣ−11n

ν

)=

1

π(µ)π′(µ)−

(ν + n

2

)×

(1

1 + (z−µ1n)TΣ−1(z−µ1n)ν

)×(

21TnΣ−1(z− µ1n)

ν

)

Podemos chamar C = Σ−1, representando a precisao da matriz de covariancia, temos

dlogp(µ, ν|z)

dµ=

1

π(µ)π′(µ) +

(ν + n

2

)×

(1

1 + (z−µ1n)TC(z−µ1n)ν

)×(

2(C·1, . . . , C·n)(z− µ1n)

ν

)︸ ︷︷ ︸

gNG

, k = 1, . . . , n

onde C·k representa a soma dos elementos de cada linha da coluna k e Ckk representa o elemento da

k-esima linha da k-esima coluna. Podemos escrever a funcao de influencia para o modelo T-Student

Multivariado atraves da Proposicao (4.2.1) tendo:

gTS(ε) =

(ν + n

2

)×

(1

1 + (z−µ)′C(z−µ)ν

)×

2C·k

εk︷ ︸︸ ︷(zk − µ) +

∑j 6=k C·j

εj︷ ︸︸ ︷(zj − µ)

ν

=

(ν + n

2

)×

(1

1 +∑ij(zi−µ)′Cij(zj−µ)

ν

)×

2C·k

εk︷ ︸︸ ︷(zk − µ) +

∑j 6=k C·j

εj︷ ︸︸ ︷(zj − µ)

ν

(4.3)

O caso T-Student tem uma expressao mais complicada que o caso gaussiano, mas note que

a funcao de influencia ira depender dos parametros de alcance (a = 1/φ), da constante de suavizacao κ

e dos graus de liberdade ν.

Novamente, se C·k = 1, k = 1, . . . , n retornaremos ao caso da secao anterior para a influencia

t-student univariada.

4.2.3 Caso GLG

Para o processo GLG utilizamos a mistura de escalas da distribuicao normal multivariada, afim de

obtermos uma disitruicao com caudas mais pesadas e segundo Palacios and Steel [2006] a estrutura de

41

correlacao nao e afetada pela mistura. Para este processo temos que z|Λ,β, σ2, φ, ν ∼ Normaln(µ,Σ∗(θ)).

Do mesmo modo apresentado anteriorimente para os dois processo acima, desejamos calcular a influencia

do parametro µ. Neste caso temos que λ|ν ∼ Log − Normal(−ν2 1, νΣ(θ)

). Suponha tambem que µ e

um escalar, σ2 = 1, ν responsavel pelo comportamento da cauda fixo e θ conhecidos.

Proposicao 4.2.2. A funcao de influencia para o processo GLG e dada por

gGLG(ε) =

∫ dq(ε|λ)dµ p(λ|ν)dλ∫

q(ε|λ)p(λ|ν)dλ(4.4)

onde q(ε|) representa a densidade e ε = z− µ

Demonstracao. O calculo da funcao escore a posteriori sera escrito atraves de p(µ|z) ∝ p(z|µ)π(µ). Note

que, como nao conhecemos a densidade de p(z|µ) devemos primeiramente marginalizar z com respeito a

λ atraves de

p(z|µ) =

∫p(z|µ,λ)p(λ|ν)p(ν)dλ