PEC_2013

-

Upload

diogo-silva -

Category

Documents

-

view

263 -

download

0

description

Transcript of PEC_2013

-

Probabilidades e Estatstica C

Frederico CaeiroLus Ramos

2012/13

-

Observao:

Estas folhas servem de apoio s aulas de Probabilidades e Estatstica C. Para uma melhor compre-

enso dos assuntos abordados, aconselha-se a leitura de alguns dos livros indicados nas referncias

bibliogrficas.

-

Contedo

1 Introduo Teoria da Probabilidade 11.1 Espao de Resultados e Acontecimentos . . . . . . . . . . . . . . . . . . . . . . 11.2 Probabilidade . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 31.3 Clculo Combinatrio . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 51.4 Probabilidade Condicional e Independncia . . . . . . . . . . . . . . . . . . . . . 6

2 Variveis aleatrias 92.1 Variveis aleatrias . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 92.2 Funo de distribuio . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 102.3 Classificao das variveis aleatrias . . . . . . . . . . . . . . . . . . . . . . . . 112.4 Momentos . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 122.5 Outros parmetros relevantes . . . . . . . . . . . . . . . . . . . . . . . . . . . . 142.6 Funes de uma varivel aleatria . . . . . . . . . . . . . . . . . . . . . . . . . 15

3 Vectores aleatrios 173.1 Par aleatrio discreto . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 173.2 Par aleatrio contnuo . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 193.3 Momentos de vectores aleatrios . . . . . . . . . . . . . . . . . . . . . . . . . . 20

4 Principais Distribuies 234.1 Distribuies discretas . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 23

4.1.1 Distribuio Uniforme . . . . . . . . . . . . . . . . . . . . . . . . . . . . 234.1.2 Distribuio de Bernoulli . . . . . . . . . . . . . . . . . . . . . . . . . . 244.1.3 Distribuio Binomial . . . . . . . . . . . . . . . . . . . . . . . . . . . . 244.1.4 Distribuio Geomtrica . . . . . . . . . . . . . . . . . . . . . . . . . . . 264.1.5 Distribuio Hipergeomtrica . . . . . . . . . . . . . . . . . . . . . . . . 274.1.6 Distribuio de Poisson . . . . . . . . . . . . . . . . . . . . . . . . . . . 29

4.2 Distribuies Contnuas . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 314.2.1 Distribuio Uniforme Contnua . . . . . . . . . . . . . . . . . . . . . . . 314.2.2 Distribuio Exponencial . . . . . . . . . . . . . . . . . . . . . . . . . . 324.2.3 Distribuio Normal . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 344.2.4 Distribuio do Qui Quadrado . . . . . . . . . . . . . . . . . . . . . . . 354.2.5 Distribuio t de Student . . . . . . . . . . . . . . . . . . . . . . . . . . 36

5 Teorema Limite Central 37

i

-

6 Estimao Pontual 396.1 Alguns conceitos importantes . . . . . . . . . . . . . . . . . . . . . . . . . . . . 396.2 Propriedades dos estimadores . . . . . . . . . . . . . . . . . . . . . . . . . . . . 406.3 Mtodo dos Momentos . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 436.4 Mtodo da mxima verosimilhana . . . . . . . . . . . . . . . . . . . . . . . . . 446.5 Distribuies por Amostragem . . . . . . . . . . . . . . . . . . . . . . . . . . . 46

6.5.1 Distribuio por amostragem da mdia amostral, X . . . . . . . . . . . . 466.5.2 Distribuio por amostragem da diferena de mdias amostrais, X1 X2 476.5.3 Distribuio por amostragem da varincia amostral, S2 . . . . . . . . . . 476.5.4 Distribuio por amostragem da proporo, P . . . . . . . . . . . . . . . 47

7 Estimao por Intervalo de Confiana 497.1 Intervalo de Confiana para a mdia da populao, . . . . . . . . . . . . . . . 50

7.1.1 Populao Normal com varincia conhecida . . . . . . . . . . . . . . . . 507.1.2 Populao Normal com varincia desconhecida . . . . . . . . . . . . . . 537.1.3 Populao desconhecida com varincia conhecida e n > 30 . . . . . . . . 547.1.4 Populao desconhecida com varincia desconhecida e n > 30 . . . . . . 54

7.2 Intervalo de Confiana para a varincia populacional, 2, e para o desvio padropopulacional, . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 56

7.3 Intervalo de Confiana para proporo populacional, p . . . . . . . . . . . . . . . 58

8 Teste de Hipteses 618.1 Introduo . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 618.2 Teste de Hipteses para a mdia da populao . . . . . . . . . . . . . . . . . . . 63

8.2.1 Teste bilateral . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 648.2.2 Teste unilateral direito . . . . . . . . . . . . . . . . . . . . . . . . . . . 658.2.3 Teste unilateral esquerdo . . . . . . . . . . . . . . . . . . . . . . . . . . 66

8.3 Teste de Hipteses para a varincia, 2, de uma populao Normal . . . . . . . . 678.4 Teste de Hipteses para a proporo p de uma populao . . . . . . . . . . . . . 68

9 Regresso Linear 699.1 Introduo . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 699.2 Estimadores dos Mnimos Quadrados de 0 e 1 . . . . . . . . . . . . . . . . . . 709.3 Estimao de 2 e Qualidade do Ajuste . . . . . . . . . . . . . . . . . . . . . . 719.4 Propriedades dos estimadores dos mnimos quadrados . . . . . . . . . . . . . . . 71

9.4.1 Distribuio por amostragem de 2 . . . . . . . . . . . . . . . . . . . . . 719.4.2 Distribuio por amostragem de 0 e 1 . . . . . . . . . . . . . . . . . . 72

9.5 Inferncia sobre os parmetros do Modelo de Regresso . . . . . . . . . . . . . . 739.5.1 Intervalo de Confiana e Teste de Hipteses para 1 . . . . . . . . . . . 739.5.2 Intervalo de Confiana e Teste de Hipteses para 0 . . . . . . . . . . . 749.5.3 Intervalo de Confiana e Teste de Hipteses para 2 . . . . . . . . . . . 75

10 Exerccios 7710.1 Introduo Teoria da Probabilidade . . . . . . . . . . . . . . . . . . . . . . . . 7710.2 Variveis aleatrias . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 8110.3 Vectores Aleatrios . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 85

-

10.4 Principais distribuies . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 8710.5 Teorema Limite Central . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 9210.6 Estimao Pontual . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 9310.7 Estimao por Intervalo de Confiana . . . . . . . . . . . . . . . . . . . . . . . 9510.8 Teste de Hipteses . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 9710.9 Regresso Linear . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 99

11 Tabelas 103

-

Captulo 1

Introduo Teoria da Probabilidade

1.1 Espao de Resultados e Acontecimentos

Definio 1.1 (Experincia aleatria). Uma experincia aleatria uma experincia cujo re-sultado desconhecido (antes da sua realizao), apesar de se conhecerem todos os possveisresultados.

Exemplo 1.2 (Experincia aleatria). Considere os seguintes exemplos:

E1 : Lanamento de uma moeda e observao da face voltada para cima; E2 : Lanamento de um dado e observao da face voltada para cima; E3 : Tempo de vida de uma lmpada.

Definio 1.3 (Espao de resultados ou universo). Chamamos espao de resultados ou uni-verso, e representamos por , ao conjunto de todos os possveis resultados de uma experinciaaleatria.

Observao: Diz-se que o espao de resultados, , discreto se tem um nmero finito ou infinitonumervel de elementos. Se contm um intervalo (finito ou infinito) de nmeros reais, entoo espao de resultados contnuo.

Exemplo 1.4 (Espao de resultados). Considere novamente as experincias aleatrias do Exem-plo 1.2. Temos:

E1 : = {Cara,Coroa}; E2 : = {1, 2, 3, 4, 5, 6}; E3 : = R+.

1

-

2 CAPTULO 1. INTRODUO TEORIA DA PROBABILIDADE

Exemplo 1.5 (Espao de resultados). Na experincia aleatria que consiste em lanar um dado,numerado de 1 a 6, e observar a face voltada para cima, = {1, 2, 3, 4, 5, 6}. Se forem lanadosdois dados, o espao de resultados ,

= {(1, 1), (1, 2), (1, 3), (1, 4), (1, 5), (1, 6), (2, 1), . . . , (6, 5), (6, 6)},

ou seja, = {(i, j) : i = 1, . . . , 6; j = 1, . . . , 6}.

Definio 1.6 (Acontecimento e Acontecimento elementar). Um acontecimento um sub-conjunto do espao de resultados, . Cada acontecimento formado por apenas um ponto amostral designado por acontecimento elementar ou simples.

Observao: Ao conjunto chamamos acontecimento impossvel e a acontecimento certo.

Definio 1.7 (Sub-acontecimento). A sub-acontecimento de B, e escreve-se A B, se es se a realizao de A implica a realizao de B.

Observao: Podemos aplicar as operaes usuais sobre conjuntos de modo a obter outrosacontecimentos de interesse. As operaes mais usuais so:

A unio de dois acontecimentos A e B, e representa-se por A B;

A interseco de dois acontecimentos A e B, e representa-se por A B;

O complementar do acontecimento A e representa-se por A;

A diferena dos acontecimentos A e B e representa-se por AB (= A B);

Algumas propriedades importantes:

1. Distributiva: A (B C) = (A B) (A C) e A (B C) = (A B) (A C);

2. Leis de De Morgan: A B = A B e A B = A B.

Definio 1.8 (Acontecimentos disjuntos ou mutuamente exclusivos). Dois acontecimentosA e B dizem-se disjuntos se no tm elementos em comum, ou seja, se A B = .

-

1.2. PROBABILIDADE 3

1.2 Probabilidade

Em muitas experincia aleatrias estamos interessados em medir a possibilidade de ocorrer umdeterminado acontecimento. A probabilidade permite-nos quantificar essa possibilidade.

Definio 1.9 (Definio Clssica ou de Laplace de Probabilidade). Se uma experincia ale-atria tem a si associado um nmero finito N de resultados, mutuamente exclusivos e igualmenteprovveis, ento a probabilidade de qualquer acontecimento A, P (A), dada por:

P (A) = NAN

= no de resultados favorveis a Ano de resultados possveis .

Exemplo 1.10. A probabilidade de sair face mpar, num lanamento de um dado equilibrado P (Sair face mpar) = 36 =

12 .

Definio 1.11 (Definio Frequencista de Probabilidade). A probabilidade de um aconteci-mento A dada pelo limite da frequncia relativa com que se observou A, isto ,

P (A) = limn

nAn,

onde nA representa o nmero de observaes de A, e n o nmero de realizaes da experinciaaleatria. Para valores elevados de n, podemos assumir que P (A) nA

n.

Definio 1.12 (Definio Axiomtica de Probabilidade). A Probabilidade uma funo,que a cada acontecimento A faz corresponder um valor real, P (A), e que verifica as seguintescondies ou axiomas:

1. P (A) 0, qualquer que seja o acontecimento A;

2. P () = 1;

3. Se A e B so acontecimentos disjuntos, P (A B) = P (A) + P (B).Esta axiomtica no contempla situaes com uma infinidade numervel de acontecimentos. assim usual substituir o 3o axioma, por:

3. Se A1, A2, . . . so acontecimentos disjuntos dois a dois, ento P(

i=1Ai)

= i=1 P (Ai).Proposio 1.13. Sejam A e B dois acontecimentos. Os seguintes resultados so consequnciaimediata dos axiomas da definio 1.12:

1. P () = 0;

2. Se A B ento P (A) P (B);

-

4 CAPTULO 1. INTRODUO TEORIA DA PROBABILIDADE

3. P (A) = 1 P (A);4. P (A) [0, 1];5. P (AB) = P (A B) = P (A) P (A B);6. P (A B) = P (A) + P (B) P (A B).

Demonstrao.

1. Como e so acontecimentos disjuntos e P () = P () = 1, resulta pelo 3o axiomaque P ( ) = P () + P (), ou seja, P () = 0.

2. Sejam A e B dois acontecimentos tais que A B. Ento B = B (A A) = (B A) (B A) = A (B A). Como A e B A so acontecimentos disjuntos, podemos utilizaro 3o axioma, resultando,

P (B) = P (A (B A)) = P (A) + P (B A).

Usando o 1oaxioma, podemos garantir que P (BA)0 e consequentemente P (B)P (A).

3. Como A e A so acontecimentos disjuntos, podemos utilizar o 3o axioma. Assim,

1 = P () = P (A A) = P (A) + P (A),

ou seja, P (A) = 1 P (A).

4. Pelo 1o axioma, para qualquer acontecimento A, P (A) 0. Logo, basta apenas demonstrarque P (A) 1. Como A , resulta que P (A) P () = 1.

5. Como A = (AB)(AB) = (AB)(AB), e (AB) e (AB) so acontecimentosdisjuntos, ento podemos utilizar o 3o axioma. Assim,

P (A) = P (AB) + P (A B) P (AB) = P (A) P (A B).

6. Como A B = (A B) (B A) (A B) e (A B), (B A) e (A B) soacontecimentos disjuntos dois a dois, podemos utilizar o resultado do 3o axioma, obtendo:

P (A B) = P (AB) + P (B A) + P (A B) == P (A) P (A B) + P (B) P (A B) + P (A B) == P (A) + P (B) P (A B).

Observao: O ltimo resultado da Proposio 1.13 pode ser generalizado para a unio de nacontecimentos (n 2). Assim, dados os acontecimentos Ai, i = 1, . . . , n,

P (ni=1Ai) =ni=1

P (Ai)i 6=j

P (Ai Aj)+i 6=j 6=k

P (Ai Aj Ak). . .+(1)n1 P (ni=1Ai) ;

-

1.3. CLCULO COMBINATRIO 5

Para n = 3 obtemos o caso particular:

P (ABC) = P (A)+P (B)+P (C)P (AB)P (AC)P (BC)+P (ABC).

Definio 1.14 (Acontecimentos incompatveis). Dois acontecimentos A e B dizem-se in-compatveis se P (A B) = 0.

1.3 Clculo Combinatrio

O clculo de uma probabilidade, atravs da definio clssica, depende da contagem do nmerode casos favorveis e do nmero de casos possveis. Em muitas situaes este clculo pode noser imediato. O clculo combinatrio uma ferramenta que nos poder auxiliar em muitas dessassituaes.

Definio 1.15 (Produto Cartesiano). Seja A = {a1, . . . , an} um conjunto com n elementos eB = {b1, . . . , bm} um conjunto com m elementos. Designa-se por produto cartesiano o conjuntode pares (ai, bj) em que o primeiro provm de A e o segundo de B e representa-se por AB. Onmero de elementos de AB dados por #(AB) = nm.

Considere agora que temos n elementos distintos, e pretendemos seleccionar k. De quantasmaneiras distintas possvel seleccionar os k elementos? Como existem vrias formas distintasde escolher os k elementos, a resposta questo anterior dada pela seguinte tabela:

Interessa H Designao Nmero de maneiras distintas dea ordem? repetio? escolher os k elementos

Sim No Arranjos nAk = n!(nk)! , k nSim Sim Arranjos com repetio nAk = nk

No No Combinaes nCk =(nk

)= n!(nk)!k! , k n

No Sim Combinaes com repetio nC k =(n+k1)!(n1)!k!

Observaes:

! representa a funo factorial (por conveno 0! = 1);

No caso particular em que interessa a ordem, no h repetio e estamos a seleccionar todosos elementos disponveis (k = n), mais usual designarmos Permutaes de n elementos,Pn, em vez de nAn. obvio que nAn = Pn = n!.

-

6 CAPTULO 1. INTRODUO TEORIA DA PROBABILIDADE

1.4 Probabilidade Condicional e Independncia

Vamos comear por um exemplo que ir introduzir a noo de probabilidade condicional.

Exemplo 1.16. Uma empresa farmacutica realizou um ensaio clnico para comparar a eficcia deum novo medicamento (medicamento experimental). Escolheram-se ao acaso 200 doentes com adoena que se pretende curar. Metade desses doentes foram tratados com o novo medicamento eos restantes com um medicamento convencional. Ao fim de 5 dias, os resultados so os seguintes:

Melhorou (M) No melhorou (M) TotalMedicamento Experimental E 69 31 100Medicamento Convencional (E) 58 42 100

Total 127 73 200

1. Qual a probabilidade, de um doente escolhido ao acaso,

(a) tomar o medicamento experimental?Resposta: Usando a regra de Laplace, P (E) = 100200 =

12 .

(b) tomar o medicamento experimental e melhorar?Resposta: Usando a regra de Laplace, P (E M) = 69200 .

2. Qual a probabilidade de um doente, que melhorou, ter tomado o medicamento experimental?Resposta: 69127 .

Observao: A soluo da pergunta 2, do exemplo anterior, igual a P (EM)P (M) .

Definio 1.17 (Probabilidade Condicional). Sejam A e B dois acontecimentos. A probabili-dade condicional de A dado B

P (A|B) = P (A B)P (B) , se P (B) > 0.

Teorema 1.18 (Teorema da Probabilidade Composta). Sejam A e B dois acontecimentostais que P (B) > 0. Ento, resulta da definio de Probabilidade Condicional,

P (A B) = P (A |B )P (B) .

Observao: Nalguns casos, a probabilidade condicional P (A|B) pode ser igual a P (A), ou seja,o conhecimento da ocorrncia de B no afecta a probabilidade de A ocorrer.

Definio 1.19 (Acontecimentos Independentes). Dois acontecimentos A e B dizem-se inde-pendentes se e s se,

P (A B) = P (A)P (B) .

-

1.4. PROBABILIDADE CONDICIONAL E INDEPENDNCIA 7

Definio 1.20 (Partio do espao de resultados). Dizemos que {E1, . . . , En} uma partiodo espao de resultados quando

Ei Ej = (i 6= j) e ni=1 Ei = .

Teorema 1.21 (Teorema da Probabilidade Total). Seja {E1, . . . , En} uma partio do espaode resultados , com P (Ei) > 0, i. Dado um qualquer acontecimento A, tem-se,

P (A) = P (A |E1 )P (E1) + . . .+ P (A |En )P (En) .

Teorema 1.22 (Teorema de Bayes). Seja {E1, . . . , En} uma partio do espao de resultados, com P (Ei) > 0, i. Dado um qualquer acontecimento A, com P (A) > 0, tem-se

P (Ei |A) = P (A |Ei )P (Ei)ni=1

P (A |Ei )P (Ei).

Demonstrao. Aplicando a definio 1.17, de Probabilidade Condicional, depois o Teorema 1.18da Probabilidade Composta e o Teorema 1.21 da Probabilidade Total,

P (Ei |A) = P (Ei A)P (A) =

P (A |Ei )P (Ei)ni=1

P (A |Ei )P (Ei).

Exemplo 1.23 (Teste de P.E. D - 2007/08). Diga, justificando, se a seguinte afirmao verda-deira ou falsa:Trs mquinas A, B e C produzem botes, respectivamente, 15%, 25% e 60% da produo total.As percentagens de botes defeituosos fabricados por estas mquinas so respectivamente 5%, 7%e 4%. Se ao acaso, da produo total de botes, for encontrado um defeituoso, a probabilidadede ele ter sido produzido pela mquina B de cerca de 36%.

Resoluo:Sejam A, B, C e D os seguintes acontecimentos:A - O Boto produzido pela mquina A;B - O Boto produzido pela mquina B;C - O Boto produzido pela mquina C;D - O Boto tem defeito;

De acordo com o enunciado, temos as seguintes probabilidades: P (A) = 0.15, P (B) = 0.25,P (C) = 0.6, P (D|A) = 0.05, P (D|B) = 0.07 e P (D|C) = 0.04.

-

8 CAPTULO 1. INTRODUO TEORIA DA PROBABILIDADE

Pretende-se determinar P (B|D). Usando o Teorema de Bayes, obtemos:

P (B|D) = P (D|B)P (B)P (D|A)P (A) + P (D|B)P (B) + P (D|C)P (C) =

175490 ' 36%.

Logo a afirmao est correcta, isto , a probabilidade de um boto defeituoso ter sido produzidopela mquina B de cerca de 36%.

-

Captulo 2

Variveis aleatrias

2.1 Variveis aleatrias

Definio 2.1 (Varivel aleatria). Uma varivel aleatria (v.a.), X : R, uma funo reale finita, tal que a imagem inversa de ];x] um acontecimento, isto , Ax = X1(;x] ={ : X () x} com x R um acontecimento.

Observao: fcil de verificar que se X uma varivel aleatria e g : R R uma funo,ento Y = g(X) tambm uma varivel aleatria.

Exemplo 2.2 (Varivel aleatria). Considere a experincia aleatria que consiste no lanamentode 2 moedas equilibradas, e registo da face voltada para cima. O espao de resultados

= {(Ca,Ca), (Ca,Co), (Co,Ca), (Co,Co)}.

Podemos, por exemplo, atribuir a cada um dos acontecimentos elementares de , os seguintevalores:

(Ca,Ca) (Ca,Co) (Co,Ca) (Co,Co)X() 2 1 1 0

Repare que

Ax = X1](;x]) =

, x < 0

{(Co,Co)} 0 x < 1{(Co,Co), (Ca,Co), (Co,Ca)} 1 x < 2

x 2

Como todas as imagens inversas, X1(];x]), so acontecimentos de , ento de acordo coma definio 2.1, X uma varivel aleatria.

Observao: Relativamente ao Exemplo 2.2, X a aplicao que atribui a cada acontecimentode o nmero de caras.

9

-

10 CAPTULO 2. VARIVEIS ALEATRIAS

2.2 Funo de distribuio

Definio 2.3 (Funo de distribuio). A funo de distribuio da v.a. X :

FX(x) = P (X x) = P ({ : X() x}), x R.

Exemplo 2.4. Considere novamente o Exemplo 2.2. A funo de distribuio desta v.a. :

FX(x) = P (X x) =

0, x < 014 , 0 x < 134 , 1 x < 21, x 2

Observao: Como FX(x) = P (X x), conclui-se que a funo de distribuio existe sem-pre. Quando no existir mais do que uma v.a., pode-se representar a funo de distribuiosimplesmente por F .

Propriedades da funo de distribuio:

1. limxF (x) = 0 e limx+F (x) = 1;

2. F contnua direita, isto , limxa+

F (x) = F (a);

3. F no decrescente, isto , se x < y, ento F (x) F (y).

Teorema 2.5. Qualquer funo F uma funo de distribuio se e s se verificar as trspropriedades anteriores.

Proposio 2.6. Seja X uma v.a. com funo de distribuio F . Tem-se:

P (X = x) = P (X x) P (X < x) = F (x) F (x), x R,

onde F (x) = limtx

F (t).

Definio 2.7 (Variveis aleatrias identicamente distribudas). Duas variveis aleatriasX e Y dizem-se identicamente distribudas, se tm a mesma funo de distribuio, isto , seFX(x) = FY (x), x R.

-

2.3. CLASSIFICAO DAS VARIVEIS ALEATRIAS 11

2.3 Classificao das variveis aleatrias

A funo de distribuio no necessariamente contnua em todos os valores x R. Podemospor isso classificar as variveis aleatrias em funo da continuidade da respectiva funo dedistribuio. Considere o conjunto de pontos de descontinuidade da funo de distribuio F ,

D = {a R : P (X = a) > 0} . (2.1)

Definio 2.8 (Varivel aleatria discreta). Uma v.a. X diz-se do tipo discreto ou simples-mente discreta se o conjunto D quanto muito numervel, e se P (X D) = 1.

Definio 2.9 (Funo de probabilidade). Seja X uma v.a. discreta. Chama-se funo deprobabilidade (f.p.), ou funo massa de probabilidade, de X funo definida pelo conjunto dosvalores deD e pelas respectivas probabilidades, isto , por (xi, pi) onde xi D e pi = P (X = xi).Uma representao usual para a funo de probabilidade da v.a. X, :

X ={

x1 x2 . . . xi . . .P (X = x1) P (X = x2) . . . P (X = xi) . . .

Propriedades da funo de probabilidade:

1. P (X = xi) = f(xi) = pi 0;2. i=1 pi = 1.

Observao: Para qualquer subconjunto real I, P (X I) = xiID P (X = xi).Exemplo 2.10. Considere novamente o Exemplo 2.2. O conjunto de pontos de descontinuidadeda funo de distribuio D = {0, 1, 2}. Como P (X D) = 1, conclui-se que X uma v.a.discreta com funo de probabilidade,

X

{0 1 214

12

14

Definio 2.11 (Varivel aleatria contnua). Uma v.a. X diz-se do tipo contnuo ou simples-mente contnua se D = e se existe uma funo no negativa, f , tal que para I R,

P (X I) =If(x)dx.

funo f chamamos funo densidade probabilidade ou funo densidade.

-

12 CAPTULO 2. VARIVEIS ALEATRIAS

Propriedades da funo densidade probabilidade:

1. f (x) 0, x R;2.+ f (x) dx = 1.

Observao: ComoI f(x)dx um integral de uma funo no negativa e sempre convergente,

ento a P (X I), corresponde ao valor da rea entre o eixo das abcissas e o grfico da funof no conjunto I considerado. Consequentemente P (X = x) = 0, x R e

P (x1Xx2) = P (x1

-

2.4. MOMENTOS 13

Propriedades do valor esperado:

1. Se a uma constante, E(a) = a;

2. Se a e b so constantes, E(aX + b) = aE(X) + b.

3. Se existirem E(g1(X)) e E(g2(X)), ento

E(g1(X) + g2(X)) = E(g1(X)) + E(g2(X)).

Definio 2.15 (Momentos de ordem k). SejaX uma varivel aleatria. Definem-se momentosde ordem k em torno da origem por:

mk = E(Xk),

e os momentos centrais de ordem k de X por:

k = E((X )k),

desde que os valores esperados existam.

Definio 2.16 (Varincia e desvio padro). A varincia da v.a. X, 2 ou V (X), o momentocentral de ordem dois, isto ,

2 = V (X) = E((X )2),

desde que exista o valor esperado de (X )2. sua raiz quadrada positiva, = V (X),chamamos desvio padro da v.a. X.

Proposio 2.17. Se X uma v.a., para a qual existe varincia, V (X)=E(X2)E2 (X).

Propriedades da Varincia:

1. Se a uma constante, V (a) = 0;

2. Se a e b so constantes, V (aX + b) = a2V (X).

Exemplo 2.18. Considere a varivel aleatria introduzida no Exemplo 2.2. A varincia de X :

V (X) = E((X 1)2) = (0 1)2 14 + (1 1)2 12 + (2 1)2 14 = 12 .

Nota: A varincia tambm podia ser calculada atravs do resultado da Proposio 2.17.

-

14 CAPTULO 2. VARIVEIS ALEATRIAS

Teorema 2.19 (Desigualdade de Chebychev). Se X uma v.a. para a qual existe varincia2 e c > 0 uma constante real positiva, ento

P (|X | c) 1c2 P (|X | < c) 1 1

c2.

Exemplo 2.20 (Desigualdade de Chebychev). Para c = 2, podemos dizer que a probabilidadeda v.a. X assumir valores no intervalo ] 2, + 2[ superior a 1 1/4 = 0.75.

Observao: A generalidade da Desigualdade de Chebychev impede-a de ser muito precisa.

2.5 Outros parmetros relevantes

Definio 2.21 (Coeficiente de variao). Seja X uma v.a. com suporte no negativo. OCoeficiente de variao de X ,

CV = 100%.

Definio 2.22 (Coeficiente de Simetria). O Coeficiente de simetria, de uma v.a. X, definidopor

1 =33.

Definio 2.23 (Coeficiente de achatamento ou Kurtosis). Define-se o coeficiente de acha-tamento ou kurtosis como

2 =44 3.

Definio 2.24 (Quantil). O quantil de ordem p, p, da v.a. X a soluo da equao:

F (p) = p p

f(x)dx = p, 0 < p < 1.

Se X uma v.a. discreta, a equao F (p) = p pode no ter soluo exacta. Neste casop = min{x : F (x) p}.

Definio 2.25 (Mediana). Trata-se do quantil de ordem p = 1/2. Costuma-se representar amediana, da v.a. X, por med(X).

Definio 2.26 (Moda). A Moda, representada por mo, o valor que maximiza a funo deprobabilidade ou a funo densidade probabilidade, desde que seja nico.

-

2.6. FUNES DE UMA VARIVEL ALEATRIA 15

2.6 Funes de uma varivel aleatria

Existem muitas formas de criar novas variveis aleatrias, a partir de outras j conhecidas. Muitasdestas variveis aparecem de forma natural com a resoluo de problemas. Assim, sejam X e Yvariveis aleatrias tais que Y funo de X (Y = g(X)). Interessa-nos saber como conhecer adistribuio de Y . Para isso basta conhecer a sua funo de distribuio, FY . Independentementede X ser uma v.a. discreta ou contnua, podemos sempre obter a sua funo de distribuio doseguinte modo:

FY (y) = P (Y y) = P (g(X) y) = P (Ay),

onde Ay = {x Dx : g(x) y}. Geralmente consegue-se calcular P (Ay), a partir da funo dedistribuio de X, FX .

Exemplo 2.27. Considere a v.a. X com funo de distribuio,

FX(x) =

0, x 0

5x4 4x3, 0 < x < 11, x 1

Estamos interessados em conhecer a distribuio das v.a.s Y = 2X 1 e W = X2. Comecemospor determinar a f.d. da v.a. Y :

FY (y) = P (Y y) = P (2X 1 y) = P (X y+12 ) = FX(y+12 ) =

=

0, y+12 0

5(y+1

2)4 4(y+12 )3, 0 < y+12 < 1

1, y+12 1

=

0, y 1

5(y+1

2)4 4(y+12 )3, 1 < y < 1

1, y 1

Determinemos agora a funo de distribuio de W . obvio que se w < 0, FW (w) = 0. Sew 0,

FW (w) = P (W w) = P (w X w) = FX(

w) FX(

w) = FX(

w) =

={

5w

4 4w3, 0 < w < 11,

w 1

={

5w2 4w3/2, 0 < w < 11, w 1

A procedimento, acima indicado, vlido quer X seja uma v.a. contnua ou uma v.a. discreta.Contudo no caso de X ser uma v.a. discreta, Y = g(X) tambm uma v.a. discreta. Nestasituao podemos tambm conhecer de distribuio de Y a partir da sua funo de probabilidade.

-

16 CAPTULO 2. VARIVEIS ALEATRIAS

Assim, seja Dx o suporte de X, isto , o conjunto dos valores de X com probabilidade positiva.Ento,

P (Y = y) = P (g(X) = y) = P (X Ay),

onde Ay = {x Dx : g(x) = y}.

Exemplo 2.28. Considere novamente a varivel aleatria introduzida no Exemplo 2.2 e a novavarivel aleatria Y = (X 1)2. Sendo X uma v.a. discreta, conclumos que Y tambm umav.a. discreta. Como X tem como suporte os valores 0, 1,e 2, o suporte de Y o conjunto dosvalores 0 e 1. Resulta que

P (Y = 0) = P ((X 1)2 = 0) = P (X = 1) = 12 ,P (Y = 1) = P ((X 1)2 = 1) = P (X 1 = 1 X 1 = 1) =

= P (X = 0) + P (X = 2) = 14 +14 .

Ento a funo de probabilidade de Y

Y

{0 112

12

-

Captulo 3

Vectores aleatrios

Sejam X1, X2, . . . , Xm m variveis aleatrias. Ento X = (X1, X2, . . . , Xm) um vectoraleatrio de dimenso m. Vamos restringir-nos apenas aos pares aleatrios (X,Y ) = (X1, X2),isto , aos vectores aleatrios com m = 2. Estes podem ser do tipo discreto, contnuo ou misto,conforme X e Y so v.a. de tipo discreto, contnuo ou uma discreta e a outra contnua.

Definio 3.1 (Funo de distribuio conjunta). Seja (X,Y ) um par aleatrio. A funo dede distribuio de (X,Y ) :

FX,Y (x, y) = P (X x, Y y), (x, y) R2.

3.1 Par aleatrio discreto

Definio 3.2 (Par aleatrio discreto). Diz-se que (X,Y ) um par aleatrio discreto se e sse X e Y so variveis aleatrias discretas.

Definio 3.3 (Funo de probabilidade conjunta). Seja (X,Y ) um par aleatrio discretotomando valores no conjunto D = {(xi, yj) R2 : P (X = xi, Y = yj) > 0}. Chamamos funode probabilidade conjunta (f.p.c.) de (X,Y ) funo:

pij = P (X = xi, Y = yj), i = 1, 2, . . . , j = 1, 2, . . .

Propriedades da funo de probabilidade conjunta:

1. 0 pij 1, (xi, yj) D;

2.i

j

pij = 1

Observao: Quando o conjunto D finito e pequeno costume representar a f.p.c. numatabela, idntica que a seguir se apresenta:

17

-

18 CAPTULO 3. VECTORES ALEATRIOS

X\Y y1 y2 . . . ynx1 p11 p12 . . . p1n p1x2 p21 p22 . . . p2n p2... ... ... . . . ... ...xm pm1 pm2 . . . pmn pm

p1 p2 . . . pn 1

Definio 3.4 (Funo de probabilidade marginal). Define-se funo de probabilidade marginalde X e funo de probabilidade marginal de Y como:

pi = P (X = xi) =j=1

P (X = xi, Y = yj) =j=1

pij, i = 1, 2, . . .

pj = P (Y = yj) =i=1

P (X = xi, Y = yj) =i=1

pij, j = 1, 2, . . .

Definio 3.5 (Funo de probabilidade condicional). Seja (X,Y ) um par aleatrio discreto.Define-se probabilidade condicional de X dado Y = yj como,

P (X = xi|Y = yj) = P (X = xi, Y = yj)P (Y = yj)

= pijpj

, se P (Y = yj) > 0,

e probabilidade condicional de Y dado X = xi como

P (Y = Yj |X = Xi) = P (X = xi, Y = yj)P (X = xi)

= pijpi

, se P (X = xi) > 0.

Definio 3.6 (Independncia entre variveis aleatrias discretas). As v.a.s X e Y dizem-seindependentes se, e s se, pij = pipj , i, j.

Exemplo 3.7. Seja (X,Y ) um par aleatrio discreto com a seguinte f.p.c.:

X \ Y 0 1 20 1/4 1/8 0 3/81 1/8 1/8 1/8 3/82 0 0 1/4 1/4

3/8 1/4 3/8

(a) Qual a probabilidade de X ser maior que Y ? (Soluo: 1/8)

(b) Calcule P (X 1;Y > 0). (Soluo: 3/8)

(c) X e Y so v.a.s independentes? (Soluo: X e Y no so independentes)

(d) Determine a funo de probabilidade de X|Y = 2 e calcule E(X|Y = 2).

-

3.2. PAR ALEATRIO CONTNUO 19

3.2 Par aleatrio contnuo

Definio 3.8 (Par aleatrio contnuo). Um par aleatrio (X,Y ) diz-se contnuo se existe umafuno no negativa fX,Y tal que, tal que, para qualquer regio I R2,

P ((X,Y ) I) =

IfX,Y (u, v)dudv.

A fX,Y chamamos funo densidade probabilidade conjunta ou funo densidade conjunta.

Propriedades da funo densidade probabilidade conjunta:

1. fX,Y (x, y) 0, (x, y) R2;2.+

+ fX,Y (x, y)dxdy = 1.

Definio 3.9 (Funo densidade de probabilidade marginal). Define-se a funo densidadede probabilidade marginal de X, como:

fX (x) = +

f(X,Y ) (x, y) dy, x R

De modo anlogo obtm-se a funo densidade de probabilidade marginal de Y ,

fY (y) = +

f(X,Y ) (x, y) dx, y R

Definio 3.10 (Funo densidade condicional). Em todos os pontos (x, y) onde fX,Y contnua, fY (y) > 0 e contnua, a funo densidade condicional de X, dado Y = y, existe ecalcula-se como:

fX|Y (x|y) =fX,Y (x, y)fY (y)

.

De modo anlogo, em todos os pontos (x, y) onde fX,Y contnua, fX(x) > 0 e contnua, afuno densidade condicional de Y , dado X = x, existe e calcula-se como:

fY |X(y|x) =fX,Y (x, y)fX(x)

.

Definio 3.11 (Independncia entre variveis aleatrias contnuas). Seja (X,Y ) um paraleatrio contnuo. As variveis X e Y dizem-se independentes se e s se

fX,Y (x, y) = fX(x)fY (y), (x, y) R2

-

20 CAPTULO 3. VECTORES ALEATRIOS

Exemplo 3.12. Os tempos de vida, em centenas de horas, das duas componentes principais deum sistema de controlo so v.a.s (X,Y ) com funo densidade conjunta

fX,Y (x, y) ={cx2y 0 < x < 3 , 0 < y < 20 outros valores de (x, y) R2

(a) Qual o valor de c?

fX,Y (x, y) 0, (x, y) R2 c 0 +

+

fX,Y (x, y) dxdy = 1 2

0

( 30cx2y dx

)dy = 1 c = 118

(b) Qual a probabilidade de cada uma das componentes durar mais de 100 horas?

P (X > 1, Y > 1) = 2

1

31

118x

2y dxdy = 1318

(c) Qual a probabilidade da 1a componente durar mais de 100 horas?Como fX (x) =

+ f(X,Y ) (x, y) dy =

20

118x

2y dy = x29 , 0 < x < 3, resulta que:

P (X > 1) = 31fX(x)dx =

31

x2

9 dx =2627

(d) Os tempos de vida das componentes so independentes?Como

fY (y) ={y/2 0 < y < 20 o. v. de y fX (x) =

{x2/9 0 < x < 30 o. v. de x

f (x, y) ={ 1

18x2y 0 < x < 3, 0 < y < 2

0 o. v. (x, y) = fX (x) fY (y)

Conclui-se que X e Y so v.a.s independentes.

3.3 Momentos de vectores aleatrios

Definio 3.13 (Valor mdio). Seja (X,Y ) um par aleatrio e g : R2 R uma funo real.Define-se valor mdio ou valor esperado ou mdia de g(X,Y ) como:

E(g(X,Y ))=

i=1

j=1

g(xi, yj)pij se X e Y so v.a.s discretas;+

+

g(x, y)fX,Y (x, y)dxdy se X e Y so v.a.s contnuas.

Nota: Uma das funes mais utilizadas g(x, y) = xy, obtendo-se:

E(XY )=

i=1

j=1

xiyjpij se X e Y so v.a.s discretas;+

+

xyfX,Y (x, y)dxdy se X e Y so v.a.s contnuas.

-

3.3. MOMENTOS DE VECTORES ALEATRIOS 21

Definio 3.14 (Covarincia). Sendo X = E(X) e Y = E(Y ), define-se covarincia entreas v.a.s X e Y por:

Cov (X,Y ) = E [(X X) (Y Y )] .

Proposio 3.15. Caso exista a covarincia entre X e Y , esta pode ser calculada atravs dafrmula:

Cov (X,Y ) = E (XY ) E (X)E (Y ) .

Outras propriedades do valor mdio e varincia:

1. E(X Y ) = E(X) E(Y );2. V (X Y ) = V (X) + V (Y ) 2Cov(X,Y ).

Proposio 3.16. Se X e Y so independentes, ento E(XY ) = E(X)E(Y ), e consequente-mente Cov(X,Y ) = 0.

Propriedades da Covarincia: Sejam X, Y , e Z v.a.s, a, b e c constantesreais. Ento:

1. Cov(X,Y ) = Cov(Y,X);

2. Cov(X,X) = V (X);

3. Cov (a+ bX, c+ dY ) = bd Cov (X,Y );

4. Cov (aX + bY, cZ) = ac Cov (X,Z) + bc Cov (Y, Z).

Definio 3.17 (Coeficiente de correlao). Define-se coeficiente de correlao de (X,Y ) por

(X,Y ) = Cov (X,Y )V (X)V (Y )

.

Propriedades do coeficiente de correlao:

1. 1 (X,Y ) 1;2. Se X e Y so v.a.s independentes, ento (X,Y ) = 0.

-

22 CAPTULO 3. VECTORES ALEATRIOS

-

Captulo 4

Principais Distribuies

4.1 Distribuies discretas4.1.1 Distribuio Uniforme

Definio 4.1 (Distribuio Uniforme Discreta). Dizemos que a varivel aleatriaX segue umadistribuio Uniforme Discreta de parmetro n e escrevemos X Unif(n), ou abreviadamente,X U(n), se a funo de probabilidade de X dada por:

X

{1 2 . . . n1n

1n . . .

1n

ou P (X = x) = 1n, x = 1, . . . , n.

A respectiva funo de distribuio :

F (x) =

0, x < 1kn , k x < k + 1, k = 1, . . . , n 11, x n

.

Proposio 4.2 (Valor mdio e Varincia). Considere a v.a. X Unif(n). Ento,

E(X) = n+ 12 e V (X) =n2 1

12 .

Demonstrao. 1

E(X) =nx=1

x1n

= 1n

nx=1

x = 1n n(n+ 1)2 =

n+ 12 .

Para calcular a varincia, mais fcil utilizar o resultado V (X) = E(X2) E2(X). Assim,

E(X2) =nx=1

x21n

= 1n

nx=1

x2 = 1n n(n+ 1)(2n+ 1)6 =

(n+ 1)(2n+ 1)6 .

Logo V (X) = (n+1)(2n+1)6 (n+1

2

)2= n2112 .

1Utilizam-se aqui os resultados, 1+ 2+ 3+ . . .+ n = n(n+1)2 e 12 +22 +32 + . . .+ n2 = n(n+1)(2n+1)6 , n N,

que se podem confirmar por Induo Matemtica.

23

-

24 CAPTULO 4. PRINCIPAIS DISTRIBUIES

4.1.2 Distribuio de Bernoulli

Definio 4.3 (Prova de Bernoulli). Trata-se de um experincia aleatria com apenas doisresultados possveis (que se costumam designar por Sucesso ou Insucesso).

Definio 4.4 (Distribuio de Bernoulli). sempre possvel definir uma varivel aleatria Xque toma o valor 1 se o resultado da experincia Sucesso e 0 se Insucesso. Denotandop = P (Sucesso) > 0, ento a funo de probabilidade de X dada por:

X

{0 1

1 p p ou P (X = x) = px(1 p)1x, x = 0, 1, 0 < p < 1.

Dizemos que a v.a. X segue uma distribuio de Bernoulli, de parmetro p, e escrevemosX Ber(p).

Proposio 4.5. Seja a v.a. X Ber(p). Ento

E(X) = p e V (X) = p(1 p).

4.1.3 Distribuio Binomial

Definio 4.6 (Distribuio Binomial). Considere-se uma sucesso de provas de Bernoulli in-dependentes, onde em cada prova a probabilidade de sucesso, p, constante. A v.a. X=nmero de sucessos em n provas de Bernoulli segue uma distribuio Binomial de parmetrosn e p, e escrevemos X Bin(n, p). A funo de probabilidade :

P (X = x) =(n

x

)px(1 p)nx, x = 0, 1, . . . , n, 0 < p < 1.

0 1 2 3 40.0

0.1

0.2

0.3

0.4

0.5

Bin(n=4 , p=0.25)

x

P(X=

k)

0 1 2 3 40.0

0.1

0.2

0.3

0.4

0.5

Bin(n=4 , p=0.5)

x

P(X=

k)

0 1 2 3 40.0

0.1

0.2

0.3

0.4

0.5

Bin(n=4 , p=0.75)

x

P(X=

k)

Figura 4.1: Grficos da funo de probabilidade de uma v.a. Bin(4, p), para alguns valores de p.

-

4.1. DISTRIBUIES DISCRETAS 25

Observao: Pela definio anterior, temos que X = I1 + I2 + . . . + In, onde Ii, i = 1, . . . , nso v.a.s independentes com distribuio Ber(p).

Proposio 4.7. Seja X uma varivel aleatria com distribuio Bin(n, p). Ento a nova v.a.Y = nX tem distribuio Bin(n, 1 p).

Proposio 4.8 (Valor mdio e Varincia). Considere a v.a. X Bin(n, p). Ento,

E(X) = np e V (X) = np(1 p).

Demonstrao. A demonstrao torna-se mais simples se usarmos a representao X = I1 +I2 +. . .+ In, introduzida na ltima observao. Assim,

E(X) = E(I1 + I2 + . . .+ In) = E(I1) + E(I2) + . . .+ E(In) = p+ p+ . . .+ p = np.

Atendendo independncia das variveis Ii,

V (X) = V (I1 + I2 + . . .+ In) = V (I1) + V (I2) + . . .+ V (In) = np(1 p).

Exemplo 4.9 (Exame de P.E. D - 2007/08). Num concurso de televiso o apresentador prope aoconcorrente o seguinte jogo: atiram-se ao ar 3 moedas, em simultneo, e se todos os lanamentosresultarem em caras o apresentador d 10 e ao concorrente; Se todos os lanamentos resultaremem coroas o apresentador d igualmente ao concorrente 10 e. Mas se os lanamentos resultaremem 2 caras e 1 coroa ou em 2 coroas e 1 cara, o concorrente tem de dar ao apresentador 5 e.

(a) Represente X a quantidade de dinheiro ganha pelo concorrente. Determine a sua funode probabilidade.

(b) Baseado no valor esperado de X, diga se o concorrente deve aceitar jogar este jogo.

Resoluo:

(a) Considere a v.a. Y: nmero de caras obtidas em 3 lanamentos de uma moeda (equili-brada). Ento como em cada lanamento o resultado cara (sucesso) ou coroa (insucesso)e os resultados dos lanamentos so mutuamente independentes, Y Bin(3, 1/2).Como P (X = 5) = P (Y = 1) + P (Y = 2) = 3/4 e P (X = 10) = P (Y = 0) + P (Y =3) = 1/4, resulta a seguinte funo de probabilidade:

X

{ 5 103/4 1/4

(b) Como E(X) = 5/4 < 0, o concorrente no deve jogar.

-

26 CAPTULO 4. PRINCIPAIS DISTRIBUIES

Proposio 4.10 (Aditividade). Sejam Xi, i = 1, . . . ,m, m v.a.s independentes tais queXi Bin(ni, p). Ento a sua soma tem tambm distribuio Binomial, isto ,

Sm =mi=1

Xi Bin(n1 + . . .+ nm, p).

4.1.4 Distribuio Geomtrica

Definio 4.11 (Distribuio Geomtrica). Considere-se uma sucesso de provas de Bernoulliindependentes, onde em cada prova a probabilidade de sucesso, p, constante. A v.a. X=nmero de provas necessrias at ocorrer o primeiro sucesso segue uma distribuio Geomtricade parmetro p, e escrevemos X G(p). A funo de probabilidade :

P (X = x) = p(1 p)x1, x = 1, 2, . . . , 0 < p < 1.

Observao: O nome desta distribuio deve-se ao facto da sucesso das probabilidades ser umaprogresso geomtrica de razo 1 p.

5 10 15 200.0

0.1

0.2

0.3

0.4

0.5

G(0.25)

x

P(X=

k)

5 10 15 200.0

0.1

0.2

0.3

0.4

0.5

G(0.5)

x

P(X=

k)

Figura 4.2: Grficos da funo de probabilidade de uma v.a. G(p), para alguns valores de p.

Proposio 4.12 (Valor mdio e Varincia). Considere a v.a. X G(p). Ento,

E(X) = 1p

e V (X) = 1 pp2

Demonstrao. O clculo do valor mdio e da varincia mais fcil se usarmos alguns dos re-sultados das sries de funes: Assim seja S(r) = k=0 rk uma srie geomtrica de razo r.Resulta que:

1. S(r) =k=0

rk = 11r , |r| < 1;

2. S(r) =k=1

krk1 = 1(1r)2 , |r| < 1;

-

4.1. DISTRIBUIES DISCRETAS 27

3. S(r) =k=2

k(k 1)rk2 = 2(1r)3 , |r| < 1.

Assim,

E(X) =x=1

x p(1 p)x1 = p S(1 p) = p 1p2 =

1p .

Para se conseguir calcular a varincia, de um modo mais fcil, usa-se mais uma vez o resultadoV (X) = E(X2) E2(X). Tem-se,

E(X2) =x=1

x2 p(1 p)x1 =x=1

x(x 1 + 1) p(1 p)x1 =

=x=1

x(x 1) p(1 p)x1 +x=1

x p(1 p)x1 =

= p(1 p)x=2

x(x 1) (1 p)x2 + E(X) = p(1 p)S(1 p) + E(X) =

= p(1 p) 2p3 +

1p =

2(1p)+pp2 =

2pp2

Ento,

V (X) = 2pp2 1p2 = 1pp2 .

Proposio 4.13. Temos que F (x) = P (X x) = 1 (1 p)[x], x 1, onde [x] representa aparte inteira de x;

Como as provas de Bernoulli so independentes, a contagem do nmero de provas necessriasat ao proximo sucesso pode ser recomeada em qualquer prova, sem que isso altere a distribuioda varivel aleatria.

Proposio 4.14 (Propriedade da falta de memria da distribuio Geomtrica). SejaX G(p). Sendo x e y inteiros positivos,

P (X > x+ y|X > y) = P (X > x).

4.1.5 Distribuio Hipergeomtrica

Definio 4.15 (Distribuio Hipergeomtrica). Considere-se uma populao de N elemen-tos, dos quais M possuem determinada caracterstica e os restantes (N M) no a possuem(dicotomia). Considere-se a experincia aleatria que consiste em seleccionar ao acaso e semreposio n elementos (amostra). Associada a esta experincia aleatria, defina-se a v.a. X - no

-

28 CAPTULO 4. PRINCIPAIS DISTRIBUIES

de elementos com a caracterstica, entre os seleccionados sem reposio. Esta v.a. X tem umafuno de probabilidade,

P (X = x) =(Mx

)(NMnx

)(Nn

) , max(0,M + nN) x min(M,n),e diz-se ter distribuio Hipergeomtrica de parmetros (N,M,n) (pode ser escrito abreviada-mente X H(N,M,n)).

Proposio 4.16 (Valor mdio e Varincia). Seja a v.a. X H(N,M,n). Ento:

E(X) =nMN e V (X) = nM

N2(N1)(N M)(N n).

Exemplo 4.17. Num aqurio existem 9 peixes, dos quais 5 esto saudveis (S) e os restantes 4esto doentes (D). Considere-se a experincia aleatria: extraco ao acaso e sem reposio de3 peixes e registo do seu estado de sade. Associada a esta experincia, considere-se a v.a. X -nmero de peixes saudveis na amostra extrada de 3 peixes. Quantos peixes saudveis esperamosencontrar em cada extraco?Resposta: Como X H(9, 5, 3), o nmero de peixes saudveis, que esperamos encontrar emcada extraco de 3 peixes, E(X) = 5/3.

Nota: Em situaes em que se conhece totalmente a composio da populao e h apenas doisresultados possveis, a distribuio Binomial caracteriza extraces com reposio. Se no houverreposio, a distribuio adequada a Hipergeomtrica. Quando n pequeno, relativamenteao valor de N , a probabilidade de sucesso em cada tiragem sem reposio varia muito poucode prova para prova (na distribuio Binomial este valor constante). Este argumento permite-nos aproximar o(s) valor(es) da(s) probabilidade(s) pela distribuio Hipergeomtrica, pelo(s)valor(es) da(s) probabilidade(s) pela distribuio Binomial.

Aproximao da distribuio Hipergeomtrica pela distribuio Binomial:

Seja X uma v.a. tal que X H(N,M,n). Ento, caso nN 0.1, isto , casoo tamanho da amostra seja muito pequeno em relao ao tamanho da populao,podemos aproximar a distribuio de X pela distribuio Bin(n, p), com p = MN ,ou seja,

P (X = x) = (Mx )(NMnx )

(Nn)(n

x

)(M/N)x(1M/N)nx.

-

4.1. DISTRIBUIES DISCRETAS 29

4.1.6 Distribuio de Poisson

Definio 4.18 (Processo de Poisson). Suponha que estamos interessados em estudar a varivelaleatria X que conta o nmero de ocorrncias de um acontecimento num dado intervalo detempo2 de durao t (por exemplo, o nmero de acidentes rodovirios ocorridos num dia ou onmero de clientes que entram numa loja durante 1 hora). Temos um processo de Poisson deparmetro > 0, quando se verificam as seguintes condies:

1. A probabilidade p de ocorrer exactamente um acontecimento num intervalo de amplitudearbitrariamente pequena d proporcional sua durao, isto , p = d;

2. A probabilidade de ocorrer mais do que um acontecimento num intervalo de amplitudearbitrariamente pequena aproximadamente igual a zero;

3. O nmero de acontecimentos que ocorrem em dois intervalos disjuntos so independentes.

4. O nmero de ocorrncias em dois intervalos com a mesma durao, tm a mesma distri-buio.

Para deduzir a funo de probabilidade, vamos considerar um intervalo unitrio (t = 1),dividido em n sub-intervalos, todos com amplitude d = 1/n, com n suficientementegrande. Nas condies acima indicadas, o nmero de ocorrncias em cada sub-intervalo bem aproximado por uma v.a. Ber(p), com p = /n. Ento X tem aproximadamentedistribuio Bin(n, /n), isto ,

P (X = x) (n

x

)(n

)x(1 n)nx, x = 0, 1, . . . , n.Se n,

P (X = x) = limn

(n

x

)(n

)x(1 n)nx = exx! x = 0, 1, . . . , n.

Definio 4.19 (Distribuio de Poisson). Dizemos que a varivel aleatria X segue umadistribuio de Poisson de parmetro , e escrevemos X P (), se a funo de probabilidadede X :

P (X = x) = ex

x! , x = 0, 1, 2, . . . , > 0.

Observao: Se num processo de Poisson, os acontecimentos acorrem a uma taxa mdia ,por unidade de tempo, ento o nmero de ocorrncias num intervalo de amplitude t > 0 temdistribuio de Poisson de parmetro t.

2Note que podemos tambm considerar uma rea, um volume, etc.

-

30 CAPTULO 4. PRINCIPAIS DISTRIBUIES

Por exemplo, se durante a hora de almoo (das 12 s 14 horas) a chegada de automveis a umparque se processa a uma taxa de 180 automveis por hora e tem distribuio de Poisson, entoa distribuio do nmero de automveis que chegam em 15 minutos Poisson com parmetrot = 180 14 = 45. A distribuio do nmero de automveis que chegam durante a hora doalmoo Poisson de parmetro t = 180 2 = 360.

0 5 10 15 200.0

00.

050.

100.

150.

200.

250.

30

P(2)

x

P(X=

k)

0 5 10 15 200.0

00.

050.

100.

150.

200.

250.

30

P(10)

x

P(X=

k)

Figura 4.3: Funo de probabilidade de uma v.a. P (), para alguns valores de .

Proposio 4.20 (Valor mdio e Varincia). Seja X uma v.a. com distribuio P (). Ento,

E(X) = e V (X) = .

Aproximao da distribuio Binomial pela distribuio de Poisson

Seja X uma v.a. tal que X Bin(n, p). possvel de verificar que

limnnp

(n

x

)px(1 p)(nx) = e

x

x! , x = 0, 1, 2, . . .

Ento, caso n 50 e np 5, pode-se aproximar a distribuio de Binomial peladistribuio de Poisson com = np.

Teorema 4.21 (Aditividade). Sejam X1, X2, . . . , Xm variveis aleatrias independentes comXi P (i), i = 1, . . . ,m. Ento,

Sm =mi=1

Xi P (1 + . . .+ m).

-

4.2. DISTRIBUIES CONTNUAS 31

4.2 Distribuies Contnuas

4.2.1 Distribuio Uniforme Contnua

Definio 4.22 (Distribuio Uniforme Contnua). Dizemos que a varivel aleatria X segueuma distribuio Uniforme (contnua) no intervalo [a, b], < a < b < +, e escrevemosX Unif(a, b), ou X U(a, b), se a funo densidade probabilidade de X dada por:

f(x) ={ 1

ba , a x b0 , c.c.

A respectiva funo de distribuio dada por,

F (x) =

0, x < axaba , a x < b1, x b

-

6

ba x

f(x)

1ba

-

6

ba x

F (x)

1

Figura 4.4: Funo densidade (esquerda) e funo de distribuio (direita) de uma v.a. U(a, b).

Proposio 4.23 (Valor mdio e Varincia). Seja a v.a. X U(a, b). Ento:

E(X) = a+ b2 e V (X) =(b a)2

12 .

Demonstrao.

E(X) = +

xf(x)dx = ba

x

b adx =[

x2

2(b a)

]ba

= b2 a2

2(b a) =a+ b

2

Como,

E(X2) = +

x2f(x)dx = ba

x2

b adx =[

x3

3(b a)

]ba

= b2 + ab+ a2

3 ,

-

32 CAPTULO 4. PRINCIPAIS DISTRIBUIES

resulta que a varincia

V (X) = E(X2) E2(X) = b2 + ab+ a2

3 (a+ b)2

4 =b2 + a2 2ab

12 =(b a)2

12 .

O caso particular da distribuio Uniforme com a = 0 e b = 1 o que apresenta mais interesse,devido ao seguinte teorema:

Teorema 4.24 (Teorema da Transformao Uniformizante). Seja X uma varivel aleat-ria contnua, com funo de distribuio FX(x). Ento a varivel aleatria Y = FX(X) temdistribuio U(0, 1).

4.2.2 Distribuio Exponencial

Comeamos por introduzir a funo Gama, presente em muitos livros de Anlise Matemtica.

A funo Gama corresponde ao integral:

(a) =

0xa1exdx, a > 0 (4.1)

Propriedades da funo Gama:

1. (+ 1) = ();

2. (n) = (n 1)!, n N3. (1/2) = pi

4.0 x

1exdx = () .

Definio 4.25 (Distribuio Exponencial). Uma varivel aleatria X diz-se seguir uma dis-tribuio Exponencial de parmetro , e escrevemos X Exp(), se a sua funo densidadeprobabilidade for dada por:

f(x) ={

0 , x 0; ex, x > 0; > 0.

A sua funo de distribuio dada por:

F (x) ={

0, x 01 ex, x > 0

-

4.2. DISTRIBUIES CONTNUAS 33

0 1 2 3 40.0

0.2

0.4

0.6

0.8

1.0

Funo densidade Exponencial

x

=1=2

0 1 2 3 40.0

0.2

0.4

0.6

0.8

1.0

Funo de distribuio Exponencial

x

=1=2

Figura 4.5: Funo densidade (esquerda) e funo de distribuio (direita) de uma v.a. Exp().

Proposio 4.26 (Valor mdio e Varincia). Considere a v.a. X Exp(). Ento,

E(X) = 1

e V (X) = 12.

Demonstrao. Vamos utilizar as propriedades da funo Gama para calcular o valor mdio.Assim,

E(X) = +

xf(x)dx =

0x exdx =

0

x21 exdx = (2)2

= 1.

De modo anlogo se calcula E(X2) e se verifica que V (X) = 12 .

Proposio 4.27 (Relao entre a distribuio Exponencial e Poisson). Considere um acon-tecimento que ocorre de acordo com um Processo de Poisson de parmetro , por unidade detempo. Ento, o tempo at primeira ocorrncia e o tempo entre duas ocorrncias consecutivastem distribuio Exp().

Exemplo 4.28. Admita que o nmero de avarias de uma fotocopiadora um processo de Poissoncom taxa =5/ano. Calcule a probabilidade do tempo entre avarias consecutivas ser inferior aum ms.Resoluo: O tempo X entre avarias consecutivas tem distribuio Exp(5). Assim, a probabili-dade pedida :

P (X < 1/12) = FX(1/12) = 1 e/12 = 1 e5/12 = 0.3408.

Teorema 4.29 (Falta de memria da distribuio exponencial). Seja X Exp(). Ento:

P (X x+ y|X y) = P (X x).

-

34 CAPTULO 4. PRINCIPAIS DISTRIBUIES

4.2.3 Distribuio Normal

Definio 4.30 (Distribuio Normal). Uma varivel aleatria X diz-se seguir uma distribui-o Normal de parmetros e 2, e escrevemos X N(, 2), se a sua funo densidadeprobabilidade for dada por:

f(x) = 12pi

e(x)222 , x R, R, > 0

A funo de distribuio dada pelo integral:

F (x) = x

12pi

e(t)222 dt,

para o qual no existe soluo analtica. assim necessrio recorrer a mtodos numricos paraobter os valores desta funo.

4 2 0 2 40.0

0.1

0.2

0.3

0.4

Funo densidade normal

x

=0, =1=0, =1.5

4 2 0 2 40.0

0.2

0.4

0.6

0.8

1.0

Funo de distribuio normal

x

=0, =1=0, =1.5

Figura 4.6: Funo densidade (esquerda) e funo de distribuio (direita) de uma v.a. N(, ).

Observaes:

Esta distribuio tambm conhecida pelo nome de Gaussiana ou distribuio de Gauss.

Quando = 0 e = 1, a v.a. toma o nome de Normal reduzida. Neste caso costumerepresentar por e , respectivamente, a funo densidade e funo de distribuio.

A distribuio Normal simtrica em torno de .

Proposio 4.31 (Valor mdio e Varincia). Seja a v.a. X N(, 2). Ento

E(X) = e V (X) = 2.

Teorema 4.32. Seja X N(, 2). Resulta que,

Z = X

N(0, 1).

-

4.2. DISTRIBUIES CONTNUAS 35

Teorema 4.33. Se X N(, 2) e a, b so constantes reais, com a 6= 0, ento

Y = aX + b N(a+ b, a22).

Teorema 4.34. Sejam X1, X2, . . . , Xn, n variveis aleatrias independentes com distribuiesXi N

(i,

2i

), i = 1, 2, . . . , n. Considerando as constantes reais a1, a2, . . . , an, com algum

ai 6= 0, temos que:

Y = a1X1 + . . .+ anXn N(a11 + . . .+ ann

=Y

, a2121 + . . .+ a2n2n

=2Y

).

Note que:

Y = E(Y ) = E( ni=1

aiXi)

=ni=1

aiE (Xi) =ni=1

aii

2Y = V (Y ) = V( ni=1

aiXi)

=ni=1

a2iV (Xi) =ni=1

a2i2i

4.2.4 Distribuio do Qui Quadrado

Definio 4.35 (Distribuio do Qui Quadrado). Uma varivel aleatria X diz-se seguir umadistribuio Qui-quadrado com n graus de liberdade, e escrevemos X 2n, se a sua funodensidade probabilidade for dada por:

f(x) =

1

(n/2)2n/2 ex/2xn/21, x > 0

0 , x 0,

onde representa a funo Gama, introduzida em (4.1).

0 1 2 3 40.0

0.2

0.4

0.6

0.8

1.0

Funo densidade do Qui Quadrado

x

n=1n=3

0 1 2 3 40.0

0.2

0.4

0.6

0.8

1.0

Funo de distribuio do Qui Quadrado

x

n=1n=3

Figura 4.7: Funo densidade (esquerda) e funo de distribuio (direita) de uma v.a. 2n.

-

36 CAPTULO 4. PRINCIPAIS DISTRIBUIES

Proposio 4.36. Considere a v.a. X 2n. Ento,E(X) = n, e V (X) = 2n.

Teorema 4.37. Sejam X1, X2, . . . , Xn v.a.s independentes com distribuio Normal Reduzida.Ento,

X2i 21,e

Y = X21 +X22 + . . .+X2n 2n.

4.2.5 Distribuio t de Student

Definio 4.38 (Distribuio t de Student). Uma v.a. T diz-se ter distribuio t de Studentcom n graus de liberdade, e escreve-se T tn, se a sua funo densidade probabilidade dadapor:

f(t) =(n+1

2

)(n2)

npi

(1 + t2n

) (n+1)2 , t R.

4 2 0 2 40.0

0.1

0.2

0.3

0.4

Funo densidade

x

n=1n=3

4 2 0 2 40.0

0.2

0.4

0.6

0.8

1.0

Funo de distribuio

x

n=1n=3

Figura 4.8: Funo densidade (esquerda) e funo de distribuio (direita) de uma v.a. tn.

Proposio 4.39 (Valor mdio e Varincia). Seja X tn. Ento,E(X) = 0, n > 1, e V (X) = n

n 2 , n > 2.

Teorema 4.40. Sejam X N(0, 1) e Y 2n, com X e Y independentes. Ento a varivelaleatria,

T = XY/n

,

tem distribuio t de Student com n graus de liberdade.

-

Captulo 5

Teorema Limite Central

Apresentamos neste captulo, um dos mais importantes resultados da teoria das probabilidades eda estatstica, o Teorema Limite Central. Este teorema d-nos a distribuio aproximada da somade n variveis aleatrias independentes e identicamente distribudas.

Teorema 5.1 (Teorema Limite Central). Seja X1, X2 . . . , uma sucesso de variveis aleatriasindependentes e identicamente distribudas (i.i.d.), com valor mdio e varincia 2 6= 0, finitos.Considere as variveis aleatrias Sn e Zn, definidas por Sn =

ni=1Xi e,

Zn =Sn n

n. (5.1)

Ento a distribuio de Zn converge para uma distribuio Normal reduzida, quando n +,isto ,

Zn =Sn n

na N(0, 1).

Observao: Se no quociente da equao (5.1), que define Zn, dividirmos tanto o numeradorcomo o denominador por n, obtemos

Zn =nXn

,

onde Xn representa a mdia Sn/n. O Teorema Limite Central pode assim tambm ser enunciadoem relao mdia das variveis aleatrias Xi, em vez da soma, Sn.

Observao: O Teorema Limite Central no indica nada sobre a velocidade de convergncia deZn para a distribuio N(0, 1). Essa velocidade de convergncia depende da distribuio dasv.a.s Xi. Na prtica, este teorema usa-se muitas vezes quando n 30 (embora este valor nemsempre garanta uma boa aproximao).

Exemplo 5.2. Num estudo sobre vendas num hipermercado, concluiu-se que a procura diria dearroz (em Kg) uma v.a. com valor mdio 40Kg e desvio-padro 5Kg. Tendo sido encomendado14.500Kg de arroz para venda venda no prximo ano, qual a probabilidade deste stock cobrir aprocura de arroz nesse perodo? (Considere-se um ano com 364 dias).

37

-

38 CAPTULO 5. TEOREMA LIMITE CENTRAL

Resoluo: Seja Xi = procura de arroz no dia i, i = 1, 2, . . . , 364 e admitamos que estas v.a.sso i.i.d.. Sabemos que:

E (Xi) = 40Kg, V (Xi) = 25Kg2, i = 1, 2, . . . , 364.

A procura de arroz durante um ano ser S364 =364i=1

Xi e queremos calcular P (S364 14.500).Ignoramos qual a distribuio de S364, mas como se trata de uma soma de um grande nmero dev.a.s i.i.d. (364 > 30), ento pelo T.L.C.,

S364 364 40364 5 =

S364 14.560364 5

a N(0, 1).

Assim,

P (S364 14.500) = P(S364 14.560

364 5 14.500 14.560

364 5)

P (Z 0.63) = (0.63) = 1 (0.63) = 1 0.7357 = 0.2643.

Concluso: recomendvel comprar mais arroz!

Corolrio 5.3. Seja X uma v.a. com distribuio Binomial de parmetros n e p. Se n 30 e ptal que np > 5 e n(1 p) > 5, ento:

Xa N(np, np(1 p)).

Exemplo 5.4. Considere-se a v.a. X Bin (100, 0.1). Calculemos P (X = 10) Como n =100 30, np = 100 0.1 = 10 > 5 e n(1 p) = 100 0.9 = 90,

P (X = 10) = P (X 10) P (X 9) (10103 ) (9103 ) = (0) (0.33) == 0.5 0.3707 = 0.1293.

Nota: O valor exacto P (X = 10) =(100

10)0.1100.990 = 0.1319.

Corolrio 5.5. Seja X uma v.a. com distribuio Poisson de parmetro . Se > 5, ento:

Xa N(, ).

Exemplo 5.6. Considere X P (230). Calculemos um valor aproximado de P (X = 241).

P (X = 241) = P (X 241) P (X 240) P(Z 241230230

) P

(Z 240230230

)=

= (0.73) (0.66) = 0.7673 0.7454 = 0.0219

Nota: O valor exacto P (X = 241) = e230.230241241! = 0.0198.

-

Captulo 6

Estimao Pontual

6.1 Alguns conceitos importantes

Definio 6.1 (Populao). Uma populao consiste no conjunto de elementos sobre o qualincide o estudo estatstico.

Definio 6.2 (Caracterstica Estatstica ou Atributo). Caracterstica Estatstica ou Atributo a caracterstica que se observa nos elementos da populao.

Observao: Numa populao podemos ter mais que uma caracterstica estatstica ou atri-buto.

Exemplo 6.3. Um estudo consiste em estudar a altura dos alunos da FCT num certo ano lec-tivo. A populao em estudo constituda por todos os alunos da FCT nesse ano lectivo. Acaracterstica estatstica ou atributo a altura.

Definio 6.4 (Amostra). Uma amostra um subconjunto da populao.

Observao: Nos mtodos estatsticos, que iremos estudar, a amostra recolhida deve ser repre-sentativa da populao. Caso isso no acontea, podemos retirar concluses erradas. assimconveniente escolher os elementos da amostra de forma aleatria, ou seja, trabalhar com umaamostra aleatria.

Definio 6.5 (Amostra aleatria). Vamos admitir que cada valor observado xi a realizaoda varivel aleatria Xi, com funo de distribuio F . O vector (X1, X2, . . . , Xn) constitui umaamostra aleatria se e s se as n variveis aleatrias so independentes e tm todas a mesmadistribuio. Os valores que se obtm por concretizao da amostra aleatria so representadospor (x1, x2, . . . , xn).

Definio 6.6 (Estatstica). Uma estatstica uma qualquer funo da amostra aleatria,(X1, X2, . . . , Xn), que no depende de qualquer parmetro desconhecido.

39

-

40 CAPTULO 6. ESTIMAO PONTUAL

Observao: Da definio anterior, conclui-se que uma estatstica uma varivel aleatria. Logoqualquer estatstica tem funo de distribuio. A essa funo de distribuio d-se o nome dedistribuio por amostragem da estatstica.

Exemplo 6.7 (Estatstica). Dada uma amostra aleatria (X1, X2, . . . , Xn), de dimenso n, soestatsticas: A mdia amostral (X), a varincia amostral (S2), o mnimo da amostra, o mximoda amostra, a mediana, os quartis ou a prpria amostra.

Definio 6.8 (Estimador pontual e estimativa pontual). Seja (X1, X2, . . . , Xn) uma amos-tra aleatria de dimenso n duma populao com funo de distribuio F (x|), com parmetrodesconhecido . Um estimador pontual de uma estatstica = h(X1, X2, . . . , Xn) des-tinada a estimar o parmetro . Depois da amostra ter sido recolhida, o valor particular de = h(x1, x2, . . . , xn), designado por estimativa pontual de .

Tabela 6.1: Alguns dos parmetros populacionais que interessam estimar e respectivos estimadorespontuais.

Parmetro Populacional Estimador PontualMdia populacional Mdia amostral

X = 1nni=1

Xi

Varincia populacional Varincia amostral2 S2 = 1n1

ni=1

(Xi X)2

Desvio padro populacional Desvio padro amostral

S =

1n1

ni=1

(Xi X)2

Proporo populacional Proporo amostralp P = Xn

6.2 Propriedades dos estimadores

Um dos principais objectivos da Estatstica a estimao de parmetros desconhecidos, comopor exemplo a mdia da populao, a partir de uma amostra. Como muitas vezes temos vriosestimadores para o mesmo parmetro, qual devemos utilizar? aconselhvel a escolha do estima-dor que melhor satisfaa um critrio de eficincia. Para definir o critrio de eficincia que iremosutilizar, precisamos das seguintes definies:

-

6.2. PROPRIEDADES DOS ESTIMADORES 41

Definio 6.9 (Estimador centrado e assintoticamente centrado). Um estimador pontual,, diz-se centrado para o parmetro se e s se

E() = .

Caso E() 6= , o estimador diz-se enviesado. A diferena b() = E() corresponde aovalor do enviesamento ou vis de . Se E() 6= , e limnE() = , diz-se que o estimador assintoticamente centrado.

Definio 6.10 (Erro Padro de um estimador). Dado um estimador pontual , centrado,define-se o seu erro padro, SE, por

SE =V ().

Caso o erro padro envolva parmetros desconhecidos, que possam ser estimados a partir dosvalores da amostra, a substituio destes valores estimados no erro padro produz o chamadoerro padro estimado, denotado por SE.

Exemplo 6.11 (Clculo do erro padro do estimador da mdia da populao - ). Seja(X1, X2, . . . , Xn) uma amostra aleatria de uma populao com valor mdio e varincia 2.Como,

E(X) = E( 1n

ni=1

Xi)

= 1n

ni=1

E(Xi) =1n

ni=1

= 1nn = ,

conclumos que X estimador centrado do valor mdio da populao, . Temos ainda,

V (X) = V(

1n

ni=1

Xi

)= 1n2V

(ni=1

Xi

)= (Xi v.a.s independentes)

= 1n2

ni=1

V (Xi) =1n2

ni=1

2 = 1n2n2 =

2

n,

ou seja, SEX =V (X) =

n.

Definio 6.12 (Erro Quadrtico Mdio). O erro quadrtico mdio de um estimador pontual de um parmetro definido por

EQM() = E[( )2

]= V () + b2(),

onde b() o vis de , definido em 6.9.

-

42 CAPTULO 6. ESTIMAO PONTUAL

Definio 6.13 (Eficincia). Sejam 1 e 2 dois estimador pontuais de uma parmetro .Diz-se que 1 mais eficiente que 2, se e s se, EQM(1) EQM(2).

O prximo resultado importante porque indica-nos o limite inferior da varincia de umestimador centrado. Um estimador com varincia igual ao valor mnimo mais eficiente do quequalquer outro estimador centrado.

Definio 6.14 (Limite inferior de Cramr-Rao). Seja (X1, X2, . . . , Xn) uma amostra aleatriaretirada de uma populao com funo densidade f(x|) (ou funo de probabilidade P (X|)),satisfazendo as condies de regularidade (f duas vezes diferencivel e com suporte independentede ). Dado um estimador pontual , centrado para ,

V () 1nI() ,

com I() = E(2 ln f(X|)

2

).

Exemplo 6.15 (Limite inferior de Cramr-Rao do modelo Poisson). Seja (X1, X2, . . . , Xn)uma amostra aleatria retirada de uma populao com distribuio Poisson de parmetro . Comoln[P (X|)] = +X ln ln(X!), resulta que

lnP (X|)

= 1 + X

; e 2 lnP (X|)

2= 1

2.

Logo,

I() = E(2 lnP (X|)

2

)= 12.

Conclui-se assim que, V () 1nI() = n , para qualquer estimador , centrado para .

Definio 6.16 (Estimador consistente). Um estimador pontual de um parmetro , diz-seconsistente se

limnEQM() = 0.

Observao: Se o estimador for centrado, ento EQM() = V (), logo ser consistente selimn V () = 0.

Exemplo 6.17 (Consistncia da Mdia amostral). Seja (X1, X2, . . . , Xn) uma amostra alea-tria de uma populao com valor mdio e varincia 2. Sabemos que X estimador centradodo valor mdio da populao, e V (X) = 2n . Como ,

limnEQM() = limnV () = limn

2

n= 0,

conclumos que X consistente para .

-

6.3. MTODO DOS MOMENTOS 43

6.3 Mtodo dos Momentos

Definio 6.18 (Mtodo dos Momentos). Seja (X1, X2, . . . , Xn) uma amostra aleatria, reti-rada de uma populao cuja distribuio depende de k parmetros desconhecidos, 1, 2, . . . , k.O mtodo dos momentos consiste em utilizar os momentos da amostra para estimar os respecti-vos momentos da populao, e consequentemente os parmetros desconhecidos. Os estimadoresde momentos, 1, 2, . . . , k, so os que resultam da resoluo do sistema de k equaes a kincgnitas,

m1 = M1m2 = M2m3 = M3

...mk = Mk

ondemj = E(Xj) (m1 = E(X))

Mj = 1nni=1

Xji (M1 = X)

Observao: Caso alguma das k equaes no contenha qualquer informao sobre os parme-tros, essa equao deve ser substituda pela equao j = Mj , com j > k.

Inconvenientes:

1. Por vezes no existe uma escolha unvoca;

2. Por vezes a soluo inadmissvel;

Exemplo 6.19 (Estimador dos momentos do parmetro , do modelo Poisson). Considereuma populao com distribuio P (). O estimador dos momentos de a soluo da equao:

E(X) = X = X.

O estimador dos momentos de , = X.

Exemplo 6.20 (Estimador dos momentos de 2 do modelo N(0, 2)). Seja (X1, X2, . . . , Xn)uma amostra aleatria, retirada de uma populao com distribuio Normal de valor mdio 0(conhecido) e varincia 2 (desconhecida). A soluo da primeira equao :

E(X) = X 0 = X.

Contudo, como esta primeira equao no contm o parmetro que interessa estimar, devemosconsiderar a segunda equao:

E(X2) = M2 E(X2) = V (X) + E2(X) = M2 2 = M2.

O estimador dos momentos de 2 , 2 =ni=1

X2in .

-

44 CAPTULO 6. ESTIMAO PONTUAL

Exemplo 6.21 (Estimadores dos momentos dos parmetro a e b, do modelo Uniforme).Considere uma populao com distribuio U(a, b). Os estimadores dos momentos de a e b soos que resultam da resoluo do sistema de equaes:

{E(X) = Xm2 = M2

a+b2 = X

(ba)212 +

(a+b

2

)2= M2

a = X

3(M2 X2)

b = X +

3(M2 X2),

ou seja os estimadores dos momentos de a e b so,

a = X

3(M2 X2) e b = X +

3(M2 X2);

6.4 Mtodo da mxima verosimilhana

Este mtodo um pouco mais complicado que o anterior. Contudo, os estimadores obtidos poreste mtodo tm melhores propriedades tericas. O mtodo apresentado apenas para populaescuja distribuio tem apenas um parmetro desconhecido.

Seja (X1, X2, . . . , Xn) uma amostra aleatria, isto , um conjunto de n v.a.s i.i.d. com funodensidade comum f(x|) onde um parmetro desconhecido. A funo densidade conjunta daamostra aleatria

f(x1, x2, . . . , xn|) =ni=1

f(xi|).

Observao: Caso a populao tenha distribuio discreta, devemos substituir a funo densi-dade pela funo de probabilidade.

Definio 6.22 (Funo de verosimilhana e log-verosimilhana). Depois da amostra serobservada, os valores x1, x2, . . . , xn so conhecidos e podemos considerar que a funo anteriordepende apenas de . Esta funo designada funo de verosimilhana e costuma representar-sepor:

L() = L(|x1, x2, . . . , xn) =ni=1

f(xi|).

geralmente mais fcil trabalhar com a funo log-verosimilhana, isto , com o logaritmo dafuno verosimilhana:

l() = lnL() =ni=1

ln f(xi|).

-

6.4. MTODO DA MXIMA VEROSIMILHANA 45

Exemplo 6.23 (Funo log-verosimilhana do modelo de Poisson()). Considere uma popu-lao com distribuio Poisson com parmetro desconhecido . Ento, observada a amostra(x1, x2, . . . , xn), e admitindo que xi N0, i = 1, 2 . . . , n, a funo log-verosimilhana :

l() = lnL() =ni=1

ln(e

xi

xi!)

= n+(

ni=1

xi

)ln

ni=1

ln(xi!).

Definio 6.24 (Mtodo da mxima verosimilhana:). O estimador de mxima verosimilhanade obtido por maximizao da funo verosimilhana, ou equivalentemente da funo log-verosimilhana, com respeito a . O estimador de mxima verosimilhana denotado por MLE ,mas para simplificao da notao representa-se apenas por . Ento:

max

l() = l()

Se L(), ou equivalentemente l(), regular (duas vezes diferencivel e com suporte inde-pendente de ) o mximo obtido por derivao, isto , obtido atravs da resoluo de:

l()

= 0, e 2l()2

< 0.

Exemplo 6.25 (Estimador de mxima verosimilhana do parmetro do modelo de Poisson).Considere a funo log-verosimilhana do exemplo 6.23. Como l() regular, o estimador demxima verosimilhana a soluo da equao

l()

= 0 n+ 1

ni=1

xi = 0 =ni=1

xi/n,

isto , o estimador de mxima verosimilhana de = X.

Propriedades dos estimadores de mxima verosimilhana

1. Os estimadores de mxima verosimilhana so assintoticamente centrados, isto ,limnE() = ;

2. Os estimadores de mxima verosimilhana so consistentes;

3. Em condies gerais de regularidade, o estimador de mxima verosimilhana de tem distribuio assintoticamente normal de valor mdio e varincia 1nI() ;

4. A propriedade da invarincia vlida para qualquer estimador de mxima verosi-milhana, isto , se um estimador de mxima verosimilhana de e se = g() uma funo biunvoca de , ento o estimador de mxima verosimilhana de = g();

-

46 CAPTULO 6. ESTIMAO PONTUAL

6.5 Distribuies por Amostragem

Nesta seco vamos estudar a distribuio por amostragem dos estimadores pontuais da Tabela6.1.

6.5.1 Distribuio por amostragem da mdia amostral, X

Suponhamos que foi seleccionada uma amostra aleatria de dimenso n, (X1, X2, . . . , Xn), deuma populao de mdia e varincia 2. A distribuio por amostragem de X pode ser obtidasob diversas condies:

1. Suponhamos a populao tem distribuio Normal e que o valor da varincia da po-pulao conhecido. Consequentemente, tendo em conta as propriedades da distribuionormal, X N(, 2/n), ou seja,

Z = X /n N(0, 1).

2. Suponhamos a populao tem distribuio Normal e que o valor da varincia dapopulao desconhecido. Vamos aqui usar S2 para estimar 2. Nestas condies,

Z = X /n N(0, 1) e (n 1)S

2

2 2n1.

Como a populao tem distribuio Normal, podemos assegurar que Z e S2 so v.a. in-dependentes (demonstrao fora do mbito desta disciplina). Logo, usando o Teorema4.40,

T = X S/n

=X/n

(n1)S2/2(n1)

tn1.

3. Suponhamos que no se conhece a distribuio da populao e que o valor da varinciada populao conhecida, mas a dimenso da amostra, n, superior ou igual a 30.Neste caso, a distribuio por amostragem da mdia amostral pode ser aproximada peladistribuio Normal reduzida, justificado atravs do Teorema Limite Central:

Z = X /n

a N(0, 1).

4. Finalmente, consideremos que seleccionmos uma amostra aleatria de uma populaocom distribuio desconhecida, com varincia da populao desconhecida e que temosum tamanho de amostra n superior ou igual a 30. Tal como no caso anterior,

Z = X /n

a N(0, 1).

-

6.5. DISTRIBUIES POR AMOSTRAGEM 47

Como 2 no conhecido, mas a dimenso da amostra grande ento S ' , e podemossubstituir, na expresso anterior, por S (desvio padro), isto ,

Z = X S/n

a N(0, 1).

6.5.2 Distribuio por amostragem da diferena de mdias amostrais, X1 X2Aqui consideramos apenas um de muitos casos possveis. Supondo que foram seleccionadas, deforma independente, duas amostras aleatrias de dimenses n1 e n2, respectivamente, de duaspopulaes Normais independentes com varincias conhecidas dadas, respectivamente, por 21 e22. Sejam X1 e X2 as mdias das duas amostras aleatrias. Neste contexto, a distribuio poramostragem de X1 X2 ainda Normal, por ser a combinao linear de variveis aleatriasnormais independentes:

Z = (X1 X2) (1 2)21n1

+ 22n2

N(0, 1).

6.5.3 Distribuio por amostragem da varincia amostral, S2

Suponhamos que foi seleccionada uma amostra aleatria de dimenso n, (X1, X2, . . . , Xn), deuma populao Normal de mdia , desconhecida, e varincia 2. Neste contexto, a distri-buio por amostragem de S2 = 1n1

ni=1

(Xi X

)2 dada por:

X2 = (n 1)S2

2 2n1.

6.5.4 Distribuio por amostragem da proporo, P

Admita que os elementos de determinada populao possuem uma dada caracterstica, com umacerta probabilidade p desconhecida, independentemente uns dos outros. Suponhamos que seselecciona uma amostra aleatria de n elementos desta populao. Se X denotar o nmerode elementos da amostra aleatria que possuem a referida caracterstica, sabemos que X Bin(n, p). Se o tamanho da amostra for suficientemente grande, o Teorema Limite Centraljustifica que:

Z = X npnp(1 p)

a N(0, 1).

Como p pode ser pontualmente estimado pela proporo de elementos que na amostra possuema referida caracterstica , P = Xn , a distribuio por amostragem aproximada de P

Z = P pp(1 p)/n

a N(0, 1).

-

48 CAPTULO 6. ESTIMAO PONTUAL

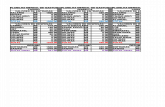

Tabela 6.2: Distribuies por amostragem

Estimador Populao Distribuio

X

Normal de mdia 2 conhecida Z = X

/n N(0, 1)

2 desconhecida T = XS/n tn1

Pop. desconhecida 2 conhecida Z = X/n

a N(0, 1)

de mdia e n30 2 desconhecida Z = XS/n

a N(0, 1)

X1X2

2 Populaes independentes,Z = (X1X2)(12)

21n1

+22n2

N(1, 21) e N(2, 22),

com 21 e 22 conhecidas N(0, 1)

P Qualquer populao e n grande Z= Ppp(1p)/n

a N(0, 1)

S2 Normal de mdia desconhecida X2 = (n1)S2

2 2n1

-

Captulo 7

Estimao por Intervalo de Confiana

A indicao de um nico valor como estimativa, de um parmetro , no nos d informaosobre a preciso desse valor. Por isso, em muitas situaes, interessa-nos dar uma medida desseerro. Assim, em vez de se indicar a sua estimativa pontual, prefervel indicar que o parmetro aestimar estar provavelmente no intervalo ]t1, t2[, onde os extremos t1 e t2 dependem do valorda estimativa pontual desse parmetro.

Definio 7.1 (Intervalo Aleatrio). Seja (X1, X2, . . . , Xn) uma amostra aleatria de umapopulao com funo de distribuio F . Considere as estatsticas

T1(X1, X2, . . . , Xn) e T2(X1, X2, . . . , Xn),

tais que P (T1 < < T2) = 1 , onde ]0, 1[ no depende de . Ento ]T1, T2[ umintervalo aleatrio para .

Definio 7.2 (Intervalo de Confiana). Seja (x1, x2, . . . , xn) uma realizao da amostra ale-atria e sejam

t1 = T1(x1, x2, . . . , xn) e t2 = T2(x1, x2, . . . , xn),

os valores das estatsticas T1 e T2 (introduzidas na Definio 7.1). Ao intervalo ]t1, t2[ chamamosintervalo de confiana (1) 100% para . O valor (1) representa o nvel (ou coeficiente)de confiana do intervalo e o nvel de significncia. Normalmente so usados nveis de confianasuperiores a 90%.

Observaes:

Diferentes amostras produziro eventuais valores distintos e consequentemente diferentesextremos t1 e t2.

Os valores t1 e t2 so denominados limites de confiana inferior e superior, respectivamente.

49

-

50 CAPTULO 7. ESTIMAO POR INTERVALO DE CONFIANA

A amplitude de um intervalo de confiana, t2 t1, uma importante medida da qualidadeda informao fornecida atravs da amostra.

Definio 7.3 (Varivel Pivot ou Fulcral). Seja (X1, X2, . . . , Xn) uma amostra aleatria, reti-rada de uma populao com funo de distribuio F de parmetro . A funo T (X1, X2, . . . , Xn) uma varivel pivot, ou fulcral, se a sua distribuio for independente de .

Observao: As variveis aleatrias Z, T e X2, apresentadas na Tabela 6.2, so variveis Pivot.

Definio 7.4 (Mtodo de determinao de um Intervalo de Confiana a partir de umavarivel Pivot). Seja (X1, X2, . . . , Xn) uma amostra aleatria, retirada de uma populao comfuno de distribuio F , com parmetro , e seja T uma varivel Pivot.

Dado o nvel de confiana (1 ), necessrio determinar os valores c1 e c2 tais que

P (c1 < T < c2) = 1 .

Caso se verifique,

c1 < T < c2 T1(X1, X2, . . . , Xn) < < T2(X1, X2, . . . , Xn),

ento tambm se pode garantir que

P (T1(X1, X2, . . . , Xn) < < T2(X1, X2, . . . , Xn)) = 1 .

Logo, o intervalo aleatrio para ]T1(X1, X2, . . . , Xn), T2(X1, X2, . . . , Xn)[ = ]T1, T2[.

Observada a amostra (x1, x2, . . . , xn), o intervalo de confiana para dado por ]t1, t2[,onde t1 = T1(x1, x2, . . . , xn) e t2 = T2(x1, x2, . . . , xn).

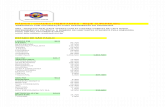

7.1 Intervalo de Confiana para a mdia da populao, 7.1.1 Populao Normal com varincia conhecida

Suponhamos que seleccionmos uma amostra aleatria (X1, X2, . . . , Xn) de uma populao Nor-mal, de varincia 2 conhecida, com a qual pretendemos construir um intervalo de confiana(1 ) 100% para .

Escolha da estatstica pivot:

Z = X /n N(0, 1);

-

7.1. INTERVALO DE CONFIANA PARA A MDIA DA POPULAO, 51

Determinao de c1 e c2: Seja za um valor tal que P (Z > za) = a. Escolhemos c1 =z1/2 = z/2 e c2 = z/2, como indicado na Figura 7.1. Esta escolha no casual.Quando c1 = c2 obtemos o intervalo de menor amplitude. O valor z/2 obtido atravsda resoluo da equao:

P(z/2 < Z < z/2

)= 1 P (Z < z/2) P (Z z/2) = 1

(z/2) (z/2) = 1 (z/2) = 1 /2 z/2 = 1 (1 /2)(7.1)

0

0.0

0.1

0.2

0.3

0.4

1

z 2 z 2

Figura 7.1: Intervalo aleatrio da varivel pivot Z.

Determinao dos extremos do intervalo aleatrio:

z/2 30, (X1, X2, . . . , Xn), deuma populao desconhecida com mdia e varincia conhecida 2, e com a qual pretendemosconstruir um intervalo de confiana (1 ) 100% para :

Escolha da estatstica pivot: Z = X/n

a N(0, 1).

Determinao de c1 e c2: De modo anlogo, ao efectuado na pgina 51, escolhemos c1 =z/2 e c2 = z/2, onde z/2 = 1(1 /2).

Repetido as contas efectuadas na sub-seco 7.1.1, obtemos:

P( z/2 < Z < z/2) = P(X z/2 n < < X + z/2 n

)= 1 .