Tópicos Extras 2ª partemarcelo.menezes.reis/Aula12CPGCC2019.pdf · 2019. 3. 8. · Tópicos...

Transcript of Tópicos Extras 2ª partemarcelo.menezes.reis/Aula12CPGCC2019.pdf · 2019. 3. 8. · Tópicos...

1

Tópicos Extras 2ª parte

Análise de Correlação e Regressão

2

Definições básicas

ANÁLISE DE CORRELAÇÃO

Mensurar a “força” da associação entre as variáveis (geralmente através do cálculo de algum coeficiente).

ANÁLISE DE REGRESSÃO

Modelo matemático (modelo de regressão): uma equação que mostre o relacionamento entre as variáveis.

Previsões.

3

Pressupostos básicos

Observações emparelhadas.

Há apenas UMA variável dependente (de resposta).

Y (Quantitativa) = f(X1, X2, ..., Xp) quantitativas/

qualitativas (dummies)

Amostra aleatória.

Quantidade suficiente de dados.

4

Classificação dos modelos

Análise de

Correlação

Análise de

Regressão

Regressão Linear

Simples

Regressão Linear

Múltipla

Regressão Não

Linear

Exponencial Logística

5

Diagrama de Dispersão

Apenas DUAS variáveis.

Diagrama cartesiano de pares (X-Y) de valores.

Identificar padrões:

Há evidência de correlação entre as variáveis?

Qual é a sua força e direção?

Possível ajustar um modelo de regressão?

6

Diagrama de Dispersão

Correlação Linear

Positiva

Correlação

Linear Negativa SEM correlação

7

Diagrama de Dispersão

0.000

20.000

40.000

60.000

80.000

100.000

120.000

140.000

0 500 1000 1500 2000 2500 3000

Peso (kg)

Te

mp

o d

e e

ntr

eg

a (

h)

Correlação NÃO LINEAR

8

Análise de Correlação

Apenas duas variáveis: correlação simples.

Coeficiente de correlação linear de Pearson: r

Mais de duas variáveis: correlação múltipla.

Análise da matriz de correlação entre as

variáveis.

Coeficiente de correlação múltipla: r múltiplo

9

Correlação linear simples

Diagrama de dispersão: correlação linear.

Coeficiente de correlação linear de Pearson (, r): medir a força e a direção do relacionamento LINEAR entre as duas variáveis:

𝑟 =𝐶𝑜𝑣(𝑋, 𝑌)

𝑠𝑋 × 𝑠𝑌=

𝑥𝑖 − 𝑥 × 𝑦𝑖 − 𝑦 𝑛𝑖=1

𝑛 − 1𝑠𝑋 × 𝑠𝑌

𝑟𝑖𝑗 =𝑠𝑖𝑗

𝑠𝑖𝑖 × 𝑠𝑗𝑗

10

Coeficiente de Correlação Linear de Pearson

r

-1 0 +1

Correlação

Linear

Negativa

Perfeita

Sem

Correlação

Linear

Correlação

Linear

Positiva

Perfeita

forte entoRelacionam 7,0r

11

Correlação linear simples

12

Teste de hipóteses sobre

Hipótese nula: = 0

Hipótese alternativa: > 0, < 0, 0

Estatística de teste:

22nr1

2nrt

Modelo de regressão

Y = β0 + β1 × X1 + β2 × X2 + ... + βp × Xp + ε

13

Pressupostos do modelo de regressão

14

Pressupostos Violações

1 Y é função linear de X1, ..., Xp e do erro Regressores inadequados, não linearidade

2 E(ε) = 0 Estimadores viesados

3 Erro tem distribuição normal, sem autocorrelação e sem correlação com X1, ..., Xp

Heterocedasticidade, autocorrelação dos resíduos

4 Observações das variáveis X1, ..., Xp

supostas sem erro. Erros de levantamento ou medida das variáveis

5 Variáveis X1, ..., Xp não têm relação linear entre si, n > p

Multicolinearidade

Etapas da Análise de Regressão

15

Identificar variáveis

independentes e a

dependente

Definir a forma da

linha de regressão

Encontrar

parâmetros da linha

de regressão com

base nos dados

Testes estatísticos:

há regressão? Quais

variáveis

independentes?

Análise de resíduos

do modelo Resíduos

OK?

SIM Previsões

NÃO

Revisar modelo Transformações

16

Regressão Linear Simples

Há apenas uma variável independente X.

Linear não significa apenas que a equação de regressão seja uma reta:

As variáveis podem sofrer transformação (logaritmos, inversão), de maneira a possibilitar um melhor ajuste ou satisfazer os pressupostos.

Transformação apenas de X, apenas de Y, ou de ambas.

O modelo é linear nos PARÂMETROS, que não podem sofrer transformação alguma.

17

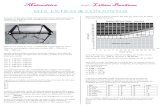

Forma da linha de regressão

preta

y = b1x +b0

vermelha

y = b1Ln(x) +b0

azul

y = b2x2 + b1x + b0

verde

y = b1xb2

laranja

y = b1eb2x

-400.000

-200.000

0.000

200.000

400.000

600.000

800.000

1000.000

1200.000

1400.000

0 500 1000 1500 2000

Peso

Te

mp

o

Estimação dos coeficientes da reta

Método dos mínimos quadrados:

18

n

i

ii YY que tal bb1

2

01ˆmin,

2

11

2

1111

n

i

i

n

i

i

n

i

i

n

i

i

n

i

ii

XXn

YXYXn

bn

XbY

b

n

i

i

n

i

i

110

19

Erro padrão da estimativa

Erro padrão da estimativa: “desvio padrão da linha de regressão”.

2n

YY

s

n

1i

2

ii

YX

20

Soma dos quadrados

Necessário avaliar se o modelo é adequado:

n

i

YYSQT1

2)( Variabilidade total em torno da média de Y

n

i

REG YYSQ1

2)ˆ( Parcela da variabilidade em torno da média

de Y “explicada” pela regressão.

n

i

YYSQR1

2)ˆ( Parcela da variabilidade em torno da média de Y

“não explicada” pela regressão:variação residual.

n

1i

2n

1i

2n

1i

2 )YY()YY()YY(

21

Soma dos quadrados

22

Coeficiente de determinação (r2)

n

i

i

n

i

i

REG

YY

YY

SQT

SQr

1

2

1

2

2

)(

ˆ

r2descreve a proporção da variabilidade em torno da média de Y que é explicada pela variação de X através do modelo de regressão.

0 r2 1

)2n(

)1n(r11r 2

ajustado2

23

Tendência e r2 no Excel y = 0.4077x - 191.15

R2 = 0.63

y = 276.45Ln(x) - 1692.6

R2 = 0.4746

y = 0.0006x2 - 0.6035x + 225.25

R2 = 0.7791

y = 0.0002x1.9746

R2 = 0.415

y = 11.582e0.0027x

R2 = 0.4631

-600.000

-400.000

-200.000

0.000

200.000

400.000

600.000

800.000

1000.000

1200.000

1400.000

0 500 1000 1500 2000

Peso

Te

mp

o

Análise dos resíduos

24

iii YYResíduo ˆ

Padronização:

𝑅𝑒𝑠í𝑑𝑢𝑜 𝑃𝑎𝑑𝑟𝑜𝑛𝑖𝑧𝑎𝑑𝑜 = 𝑌𝑖 − 𝑌 𝑖

𝑠𝑅

Diagrama de Dispersão dos Resíduos

Sem padrão, variância constante, distribuição normal.

25

26

Análise dos Resíduos - Independência e Homocedasticidade

-12

-11

-10

-9

-8

-7

-6

-5

-4

-3

-2

-1

0

1

2

3

4

5

6

7

8

9

10

11

12

0 200 400 600 800 1000 1200 1400 1600 1800 2000

Re

síd

uo

s p

ad

ron

iza

do

s

Peso (kg)

Resíduos padronizados: reta

-4

-3

-2

-1

0

1

2

3

4

0 200 400 600 800 1000 1200 1400 1600 1800 2000R

esí

du

os

pa

dro

niz

ad

os

Peso (kg)

Resíduos padronizados: exponencial

27

Análise de Resíduos - Normalidade

0

0,1

0,2

0,3

0,4

0,5

0,6

0,7

0,8

0,9

1

0 0,1 0,2 0,3 0,4 0,5 0,6 0,7 0,8 0,9 1

Pro

ba

bil

ida

de

ob

serv

ad

a

Probabilidade observada

Gráfico de probabilidade normal:resíduos padronizados reta

0

0,1

0,2

0,3

0,4

0,5

0,6

0,7

0,8

0,9

1

0 0,1 0,2 0,3 0,4 0,5 0,6 0,7 0,8 0,9 1

Pro

ba

bil

ida

de

esp

era

da

Probabilidade observada

Gráfico de probabilidade normal: resíduos padronizados exponencial

28

ANOVA para regressão

Fonte gl Soma quadrados Quadradomédio

F

Regressão P

n

1i

2

i YYgReSQQMReg =SQReg/P QMR

gReQMF

Resíduo n-P-1

n

1i

2

ii YYSQRQMR =

SQR/(n-P-1)

Total n-1

n

1i

2

i YYSQT

29

Inferências sobre 1

Teste de hipóteses:

H0: 1 = 0 H1: 1 0

1b

12n

s

bt 2

n

1i

2

i

YXb

xnx

ss

1

Intervalo de confiança:

1b2n1 stb

30

Regressão Linear Múltipla

Método dos mínimos quadrados para encontrar os coeficientes da equação.

Utilização de programas computacionais.

PP3322110 Xb...XbXbXbbY

2n

YY

s

n

1i

2

ii

YX

31

Coeficiente de determinação múltiplo

Coeficiente de determinação múltiplo, r2Y.12P, é uma das

formas de avaliar a adequação do modelo de regressão aos dados:

𝑟2𝑌.12...𝑃 =

𝑆𝑄 Re 𝑔

𝑆𝑄𝑇=

𝑌 𝑖 − 𝑌 2𝑛

𝑖=1

(𝑌𝑖 − 𝑌 )2𝑛𝑖=1

r2Y.12...P

descreve a proporção da variabilidade média de Y que é explicada pela variação média das variáveis explicativas (1 a P) através do modelo de regressão (QUALQUER modelo).

0 r2Y.12...P 1

32

Coeficiente de determinação múltiplo

É preciso ajustar o coeficiente de determinação múltiplo, para refletir o tamanho da amostra e o número de variáveis explicativas:

)1Pn(

)1n(r11r P...12.Y

2ajustado

2

Planilhas eletrônicas e pacotes estatísticos calculam o coeficiente de determinação múltiplo e o ajustado.

33

Análise de Resíduos na Regressão Múltipla

É ainda mais importante do que na regressão simples: pois muitas vezes não é possível representar graficamente o relacionamento entre as variáveis.

Mesmas definições da regressão simples: previsão dos valores de Y com base nos valores de X1, X2, ..., XP através do modelo de regressão.

Cálculo dos resíduos (diferença entre Y e Y predito), e obtenção dos resíduos padronizados.

Diagramas de dispersão: em relação à cada variável explicativa, em relação aos valores preditos.

Análise semelhante ao caso de regressão simples.

34

ANOVA para regressão múltipla

ANOVA: Análise de Variância.

Hipótese nula: não há regressão.

1 = 2 = 3 = ...= P = 0

Hipótese alternativa: há regressão.

Pelo menos um dos k 0

A variância total do modelo é decomposta em duas partes: uma devida à regressão (as P variáveis), e outra devida aos erros aleatórios (resíduos), e faz-se o quociente de ambas.

35

ANOVA para regressão múltipla

Fonte gl Soma quadrados Quadradomédio

F

Regressão P

n

1i

2

i YYgReSQQMReg =SQReg/P QMR

gReQMF

Resíduo n-P-1

n

1i

2

ii YYSQRQMR =

SQR/(n-P-1)

Total n-1

n

1i

2

i YYSQT

Testes e Intervalos de Confiança para os coeficientes na regressão múltipla

36

Testes de Hipóteses Intervalos de confiança

H0: k = 0 Xk sem efeito em Y H1: k 0 Xk com efeito em Y

Para o coeficiente k: se NÃO incluir zero, variável Xk contribui

para a regressão

𝑡𝑛−𝑃−1 =𝑏𝑘

𝑠𝑏𝑘

𝑏𝑘 ± 𝑡𝑛−𝑃−1 × 𝑠𝑏𝑘

37

Variáveis simbólicas (“dummy”)

QUALITATIVAS incorporadas ao modelo de regressão.

Usualmente podem assumir apenas 2 valores: sim e não, tem e não tem.

Tais valores são transformados em 1 e 0.

Se elas puderem assumir mais de 2 valores: devem ser criadas g-1 variáveis simbólicas (onde g é o número de valores que a variável qualitativa original pode assumir).

Consideradas exatamente iguais às outras variáveis independentes.

38

Exemplo 1

Estamos querendo avaliar o relacionamento entre o consumo mensal de óleo para calefação (em galões) em casas e três outras variáveis:

quantidade de isolamento térmico no sótão das casas (em polegadas);

temperatura atmosférica média diária (em graus Fahrenheit).

Estilo da casa (colonial ou não)

Obtenha o modelo de regressão linear múltipla.

Exemplo 2

Há interesse em prever os lucros de empresas em função das variáveis (dados de 1999):

Ativos (em US$ bilhões).

Vendas anuais (em US$ bilhões).

Lucros anuais (em US$ bilhões).

Obtenha o modelo de regressão linear múltipla.

39